Stability AI发布SD3技术报告 披露SD3更多细节

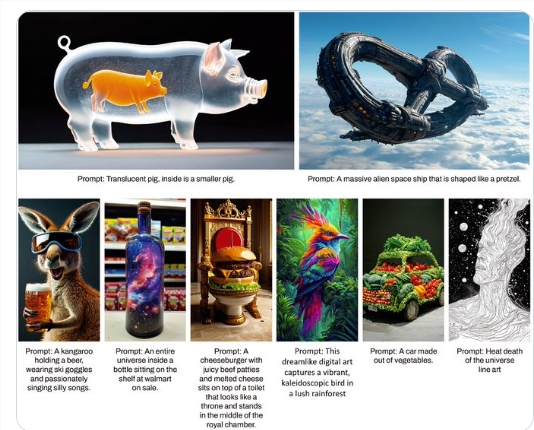

Stability AI 最近发布了他们最强的图片生成模型 Stable Diffusion3(SD3) 的技术报告,披露了 SD3的更多细节。据 Stability AI 所说,SD3在排版质量、美学质量和提示词理解上超过了目前所有的开源模型和商业模型,是目前最强的图片生成模型。

技术报告要点如下:

根据人类偏好评估,SD3在排版质量和对提示的理解程度上,均优于目前最先进的文本生成图像系统,例如 DALL·E3、Midjourney v6和 Ideogram v1。

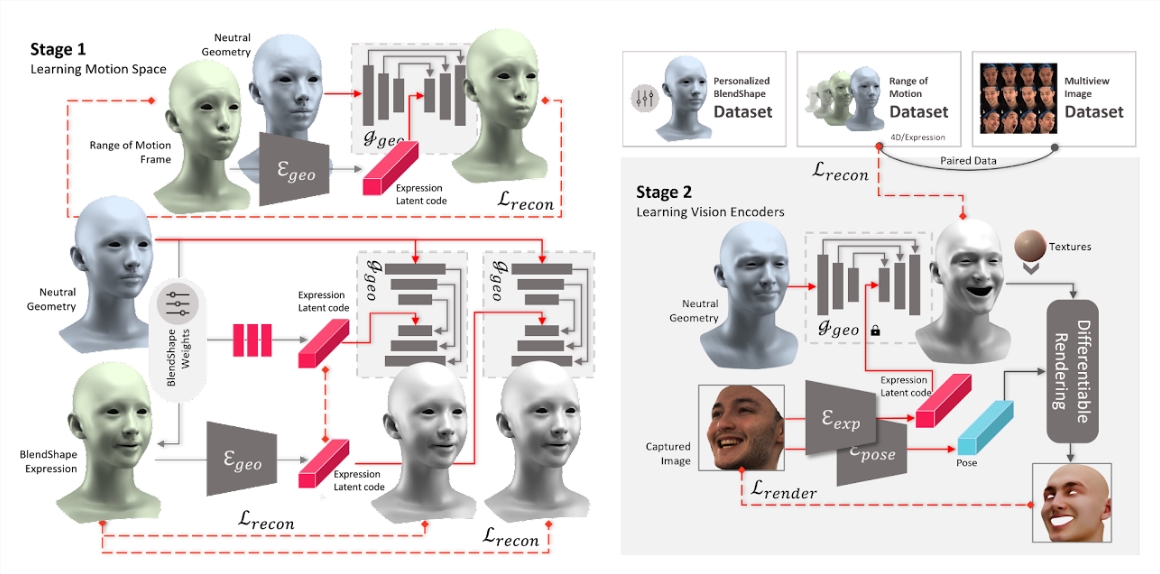

报告提出了新的多模态扩散 Transformer (Multimodal Diffusion Transformer, 简称 MMDiT) 架构,其使用独立的权重集分别表示图像和语言。与 SD3的先前版本相比,该架构改善了系统对文本的理解能力和拼写能力。

SD38B 大小的模型可以在 GTX409024G 显存上运行。此外,SD3将发布多个参数规模不等的模型方便在消费级硬件上运行,参数规模从800M 到8B。

SD3架构以 Diffusion Transformer (简称"DiT",参见 Peebles & Xie,2023)为基础。鉴于文本嵌入和图像嵌入在概念上存在较大差异,他们为这两种模态使用了独立的权重集。通过这种方法,信息得以在图像 Token 和文本 Token 之间流动,从而提高了模型生成结果的整体理解力和排版质量。

SD3采用了矫正流 (Rectified Flow, 简称 RF) 的公式,在训练过程中,数据和噪声被连接在一条线性轨迹上。这导致了更直的推理路径,从而可以使用更少的步骤进行采样。

他们还进行了扩展矫正流 Transformer 模型的研究,使用重新加权的 RF 公式和 MMDiT 主干网络,训练了一系列模型,其规模从15个 Transformer 块 (4.5亿参数) 到38个块 (80亿参数) 不等。

SD3还引入了灵活的文本编码器,通过在推理阶段移除内存密集型的 T5文本编码器(参数量高达47亿),SD3的内存占用可以大幅降低,而性能损失却很小。

总的来说,Stability AI 的这一技术报告揭示了 SD3的强大功能和细节,显示出其在图片生成领域的领先地位。

详细内容点此查看:https://stability.ai/news/stable-diffusion-3-research-paper

- 0000

- 0002

- 0000

- 0000

- 0001