生成式 AI 没有从 Web 2.0 中学到任何东西:与困扰社交平台的同样问题作斗争

自 OpenAI 在 12 个月前发布 ChatGPT 以来,它不仅创造了消费产品增长最快的记录,也引发了对于新技术的政府干预的快速响应。美国联邦选举委员会正在调查虚假的竞选广告,国会呼吁对人工智能公司如何开发和标记其算法训练数据进行监管,而欧盟则通过了对最新人工智能法案的调整,以应对生成性人工智能的挑战。

尽管人工智能技术的新颖性和发展速度令人瞩目,但其问题却也异常熟悉。OpenAI 及其竞争对手在推出新的 AI 模型时,面临着社交平台近二十年来所面临的问题。例如,Meta 公司从未能有效控制错误信息、劳动问题、非自愿色情内容等问题。如今,这些问题在 AI 技术的加持下,呈现出新的挑战。

加州大学伯克利分校信息学院的教授 Hany Farid 表示,OpenAI 等公司面临的问题是完全可以预测的,并且本可以预防。「这些都是可以预见的问题。」

延续的问题

在某些情况下,生成性人工智能公司是直接基于社交媒体公司所建立的问题基础上发展起来的。Facebook 等社交媒体依赖于低薪、外包的内容审核工人来监管仇恨言论、裸露或暴力图像等内容。

这些同样的劳动力现在被用来帮助训练生成性 AI 模型,通常也是在相似的低薪和艰难工作条件下。由于外包使社交平台或 AI 公司的关键功能在行政上与总部隔绝,并且通常位于另一个大陆,研究人员和监管机构很难完全了解 AI 系统或社交网络是如何建立和管理的。

外包还可能模糊产品内部真正智能的所在。当内容被删除时,是由算法还是众多人类审核员之一做出的决定?当客户服务聊天机器人帮助客户时,应归功于 AI 还是炎热外包中心的工作人员?

AI 公司和社交平台对于其负面或意外效应的反应也有相似之处。AI 公司谈论在某些生成性 AI 模型上实施「安全措施」和「可接受使用」政策,就像平台对于内容允许与否的服务条款一样。与社交网络的规则一样,AI 的政策和保护措施被证明相对容易规避。

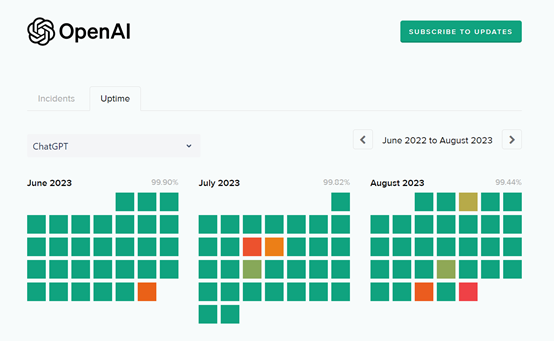

Google 今年发布其 Bard 聊天机器人后不久,研究人员发现其控制措施存在重大漏洞;在测试中,他们能够生成关于 Covid-19 和乌克兰冲突的错误信息。WIRED 对这个问题的报道引起了 Google 发言人的回应,称 Bard 是「一项早期实验,有时会提供不准确或不恰当的信息」,并声称该公司将针对有问题的内容采取行动。

目前还不清楚聊天机器人提供商是否能使其产品足够可靠,从而摆脱社交平台上的被动循环。这些平台不断但不可靠地监管新的、有问题的内容。尽管谷歌、亚马逊和 OpenAI 等公司承诺采取一些解决方案,如在 AI 生成的视频和照片中添加数字「水印」,但专家指出这些措施也容易规避,且不太可能作为长期解决方案。

虚假内容的新高度

Farid 预测,正如社交媒体平台放大了个人制作和分享信息的能力——无论这些信息是否准确或出于善意——生成性人工智能将这种能力提升到另一个层次。「我们看到了更多的错误信息,」他说。「人们现在使用生成性 AI 来创造政治候选人、政治家、新闻主播和 CEO 说他们从未说过的话的视频。」

Farid 表示,生成性 AI 不仅使制造错误和错误信息的过程更快、更便宜、更容易,而且还破坏了真实媒体和信息的可信度。就像唐纳德·特朗普(Donald Trump)试图通过称不利报道为「假新闻」来中和它们一样,今年早些时候,一位印度政治家声称泄露的录音牵涉到他的腐败丑闻是假的(实际上并非如此)。

为了应对可能扭曲 2024 年选举活动的美国政治候选人的假视频的担忧,Meta 和 YouTube 发布了政策,要求将 AI 生成的政治广告清楚地标记。但就像给生成的图像和视频打水印一样,这一政策并未涵盖其他创建和分享假媒体的方式。

尽管形势看似在恶化,但平台已开始削减检测有害内容所需的资源和团队,非营利组织 Witness 的项目主管 Sam Gregory 表示。Witness 帮助人们使用技术促进人权。主要技术公司在过去一年裁减了数以万计的员工。「我们看到了在信任和安全团队以及事实核查计划方面的大量削减,同时,这些都为混乱局面增加了一个非常不稳定的变数,」他说。「你在减少公司内部和民间社会的能力,无法关注其被欺骗性或恶意使用的方式。」

社交平台的意外后果曾与 Facebook 首席执行官马克·扎克伯格(Mark Zuckerberg)曾经流行的口号「快速行动,打破常规」(Move fast and break things)相关联。Facebook 后来放弃了这个口号,但随着 AI 公司争夺生成算法的优势,Gregory 表示他现在看到了同样鲁莽的做法。

「有一种感觉,就是不断发布新产品,却没有太多考虑,」他说,并指出,像许多大型平台一样,这些产品是如何被构建、训练、测试和部署的,都存在不透明性。

尽管美国国会和全球各地的监管机构似乎决心对生成性 AI 作出比对社交媒体更迅速的反应,但 Farid 表示,监管远远落后于 AI 的发展。这意味着新一代以生成性 AI 为重点的公司没有因为担心处罚而放慢速度的动机。

「监管机构不知道他们在做什么,而公司的发展速度如此之快,以至于没有人知道如何跟上,」他说。这指出了一个关于社会的教训,而不是关于技术。「科技公司意识到,如果他们将利润私有化,而将成本社会化,他们可以赚很多钱。令人恐惧的不是技术,而是资本主义。」

- 0000

- 0000

- 0000

- 0001

- 0001