研究:GPT-4 在执行多项现实任务中击败其他大语言模型

本文概要:

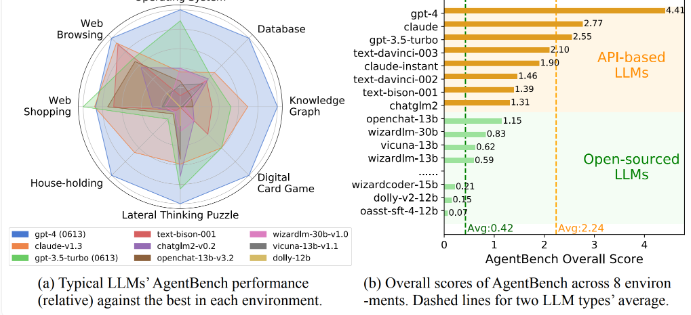

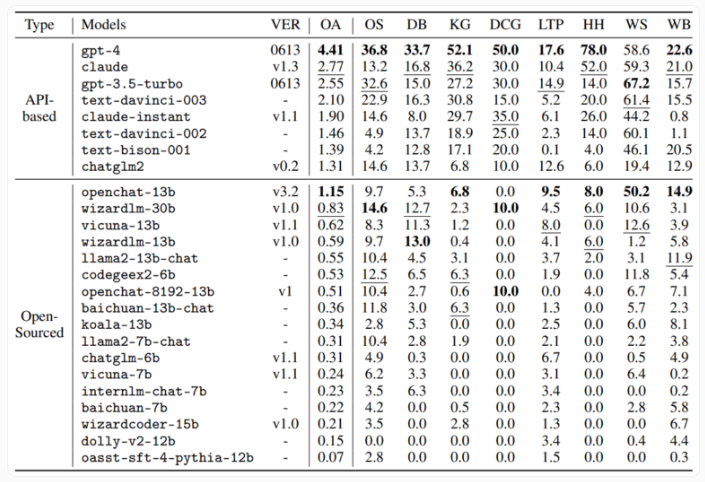

1. GPT-4在大型语言模型中表现出色,取得最高总分4.41。

2. GPT-4在几乎所有领域都领先于其他模型,只有在网购任务中,GPT-3.5表现更好。

3. 开源模型整体表现不佳,远远落后于商业模型和 GPT-3.5。

市面上已经有有许多商业和开源的文本生成人工智能。现在专门为测试辅助任务开发的基准测试表明,GPT-4在这一领域脱颖而出。

最新的研究显示,在 “现实世界语用任务” 中,GPT-4在大型语言模型中表现出色。研究团队使用一个名为 “AgentBench” 的基准测试对多个提供商的25个大型语言模型以及开源模型进行了测试。

“AgentBench”是专门为衡量大语言模型在“现实世界语用任务”中的辅助能力而设计的标准化测试。所有测试均在实时交互环境中进行。这使得该基准特别适合其想要测量的内容:大型语言模型处理总共八个领域的各种日常任务的能力。

操作系统:LLM必须执行与计算机操作系统的使用相关的任务。

数据库:这个环境是关于LLM如何与数据库合作。

知识图:此环境测试LLM如何使用知识图。

数字卡牌游戏:这测试了LLM对数字卡牌游戏和制定策略的理解程度。

横向思维难题:此挑战测试法学硕士在解决问题时的创造力。这要求他们跳出框框思考。

预算:此场景涉及基于 Alfworld 数据集的预算中发生的任务。

互联网购物:此场景测试LLM在与在线购物相关的任务上的表现。

网页浏览:基于 Mind2Web 数据集,此场景测试LLM执行与使用互联网相关的任务的能力。

结果显示,GPT-4以最高总分4.41领先于其他模型,在几乎所有领域都表现出色,只在网购任务中稍逊于 GPT-3.5。

竞争对手 Anthropic 的 Claude 模型紧随其后,总得分为2.77,领先于 OpenAI 的免费 GPT-3.5Turbo 模型。商业模型的平均得分为2.24。与开源模型相比,GPT-4的优势更加明显,开源模型的平均得分只有0.42。

研究人员指出,开源模型在所有复杂任务中普遍表现不佳,远远落后于 GPT-3.5。研究团队将工具包、数据集和基准测试环境提供给研究界,以便进行更广泛的性能比较。

- 0001

- 0000

- 0001

- 0000

- 0000