Abacus AI 推出开放式上下文大语言模型Long Context

站长网2023-08-04 15:59:110阅

Abacus.AI LLM Context Expansion 是一款能够扩展语境长度的工具,可以帮助用户扩展模型的语境长度,提高模型对长文本的处理能力。该工具基于 Abacus.AI 的 LLM(Language Model for Long-form Content)架构,提供了一系列代码和工具,用于增加模型对长文本的理解能力。通过预训练和微调,该工具可以使模型在处理超过2048个单词的文本时仍然能够保持高效和准确。

项目地址:https://github.com/abacusai/Long-Context

要点:

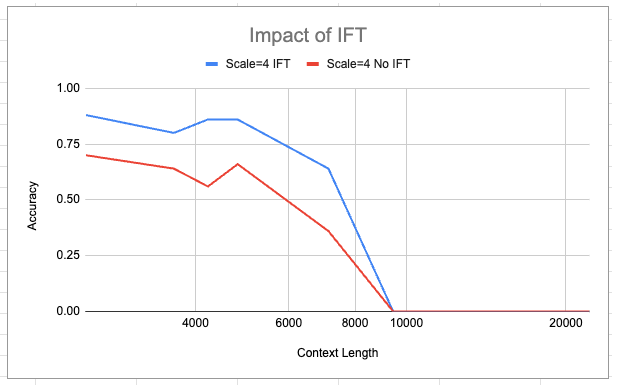

1、Abacus AI 的研究人员通过多次实验,发现将 LLMs 的上下文长度能力扩展到更长的上下文是可行的。

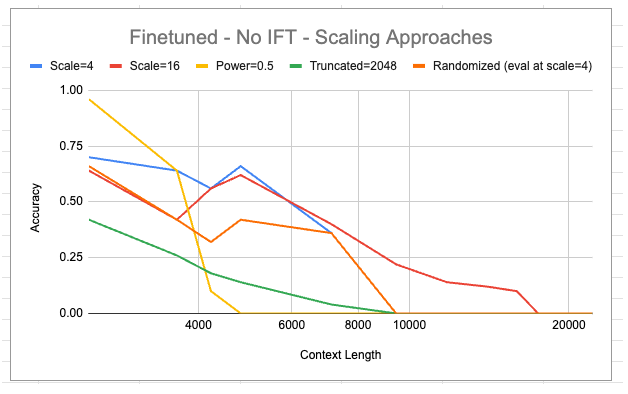

2、研究人员使用不同的方法对 RedPajama 数据集进行了 fine-tune,并发现线性缩放方法在模型上下文长度上效果良好,而截断和随机化方法在检索任务上效果较差。

3、通过评估模型在不同数据集上的表现,研究人员发现将上下文长度进行缩放可以显著提高模型的性能,进而改进模型的困惑度,并更好地捕捉文档的主题。

4、Abacus.AI LLM Context Expansion 提供了评估脚本和基准任务,用于评估模型在信息检索方面的能力,并提供了重要的实验结果和复现指南,以帮助用户进一步改进和构建自己的模型。

5、Abacus.AI提供预训练模型权重,对于表现最好的模型(线性插值 指令微调,在缩放因子为4和16时),该工具提供了预训练模型的权重,方便用户直接使用或进行自己的测试。

0000

评论列表

共(0)条相关推荐

- 0000

- 0000

- 0001

- 0000

- 0000