AI模型竟然也有偏好的数字 GPT-3.5Turbo非常喜欢47

划重点:

- 🤖 AI 模型选数字时展现出与人类相似的偏好和行为

- 🧠 人类在随机选择数字时存在固定偏好和局限性

- 🔍 AI 模型的行为源于训练数据,而非意识或思考能力

最近,人们发现了一个有趣的现象,即AI模型在选择数字时表现出类似人类的购买和避好行为,这证明了模型在回答问题时重复训练数据中的常见内容。这种行为具有确定“人性化”的特点,虽然模型本身并不具备人类的认知能力。

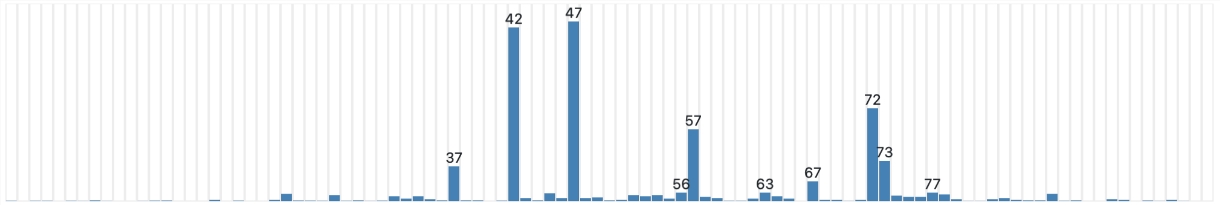

在实验中,一些工程师要求几个主要的LLM聊天机器人随机选取0到100之间的数字。结果显示,所有模型都有一个“最喜欢的”数字,表明它们在选择数字时表现出了偏好。即使在“温度”下,这三个模型在选择的其他数字时也表现出类似人类的偏见。这种现象揭示了人工智能模型表现出的“人性化”特征,解答人们与这些系统时需要记住其模仿人类行为的本质提供了启示。

Gramener 的一些工程师进行了一项非正式但仍然引人入胜的实验,他们简单地要求几个主要的 LLM 聊天机器人在0到100之间选择一个随机数字,结果并不随机。

三个经过测试的模型都有一个 “喜欢” 的数字,在最确定性的模式下,这个数字总是它们的答案,但即使在更高的 “温度” 下,这个数字也经常出现,而 “温度” 是模型通常具有的一种设置,可以增加其结果的变化性。

OpenAI 的 GPT-3.5Turbo 非常喜欢47。此前,它喜欢42—— 这个数字当然因道格拉斯・亚当斯在《银河系漫游指南》中将其定义为生命、宇宙和一切的答案而闻名。Anthropic 的 Claude3 Haiku 选择了42,Gemini 喜欢72。

更有趣的是,所有三个模型在选择其他数字时都展现出类似人类的偏见。

所有模型都倾向避免选择低位和高位数字,Claude 从不选择超过87或低于27的数字,即使有这样的数字,也是异常值。两位重复的数也被严格避免:没有33、55或66,但77出现了(以7结尾)。几乎没有以0结尾的数字 —— 尽管 Gemini 有时会选择0。

为什么会这样呢?AI 不是人类!它们为什么在意 “似乎” 随机?它们最终已经获得了意识,这是它们展示的方式吗?

不。就像通常的情况一样,我们过度赋予了拟人化。这些模型并不关心什么是随机的。它们不知道 “随机性” 是什么!它们回答这个问题的方式与回答其他问题的方式相同:查看它们的训练数据,重复在看起来像 “选择一个随机数字” 的问题之后最常出现的内容。它出现的次数越多,模型就重复它的次数越多。

尽管人工智能模型的这种行为被认为是“人性化”的特点,但我们需要意识到这并不代表模型具有真正的认知能力。模型选择的数字行为实际上只是模型重复训练数据中的常见内容,因为模型本身并不理解随机性,无法进行有效进行。因此,在这些系统的互动中,人们需要牢记它们只是模仿的人类行为,而并非真正思考或理解。

- 0000

- 0000

- 0000

- 0000

- 0001