奥特曼老黄齐预测:AGI五年内降临,代替95%工作!但马斯克断言AGI将被电力卡脖子

【新智元导读】突然间,AGI已经成为了一个新的「5年内实现」的未来技术。从Altman到老黄,都在不同场合表示,达到人类智能水平的AI将很快到来。而技术路径和未来可能出现的能源短缺,可能是达到AGI过程中的最大变数。

Claude3、Sora、Gemini1.5Pro的纷纷出现,以及或许今年内就会被放出的GPT-5,让所有人都不约而同地隐隐感觉:我们似乎离AGI似乎越来越近了。

OpenAI CEO Sam Altman坚定地认为,AGI将在5年内实现。

不过,还需要我们耐心地等待。

英伟达CEO黄仁勋的观点与Altman不谋而合:如果我们对「像人类一样思考的计算机」的定义是通过人体测试能力,那么AGI在五年内就会到来。

谷歌机器人工程师Alex Irpan,在LLM出现后,修正了自己原先对AGI出现时间的预测:4年前,他认为AGI在2035年出现的几率是10%;现在,AGI在2025年,就有10%的几率出现。

更惊人的是,预测大神Jimmy Apples曾在去年爆料:AGI其实已经在内部实现了。

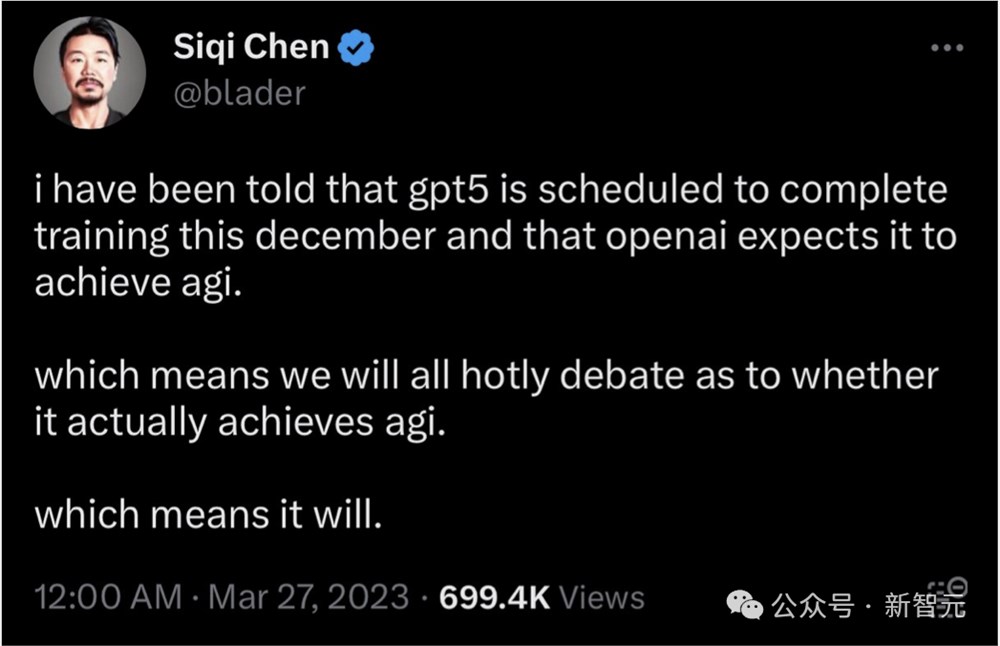

初创公司Runway CEO兼AI投资人Siqi Chen也曾在去年表示,GPT-5预计在2023年底完成训练,OpenAI期待它达到AGI水平。

如此说来,马斯克的横插一脚,让AGI进程的加快损失重大……

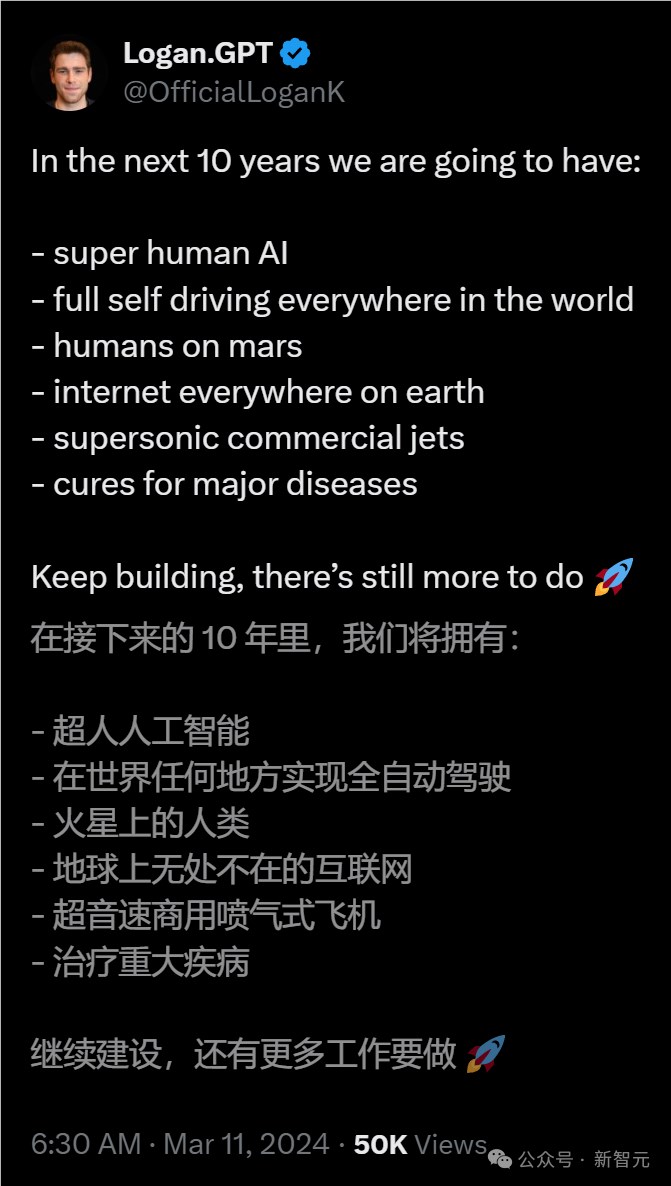

离职OpenAI员工Logan.GPT表示,接下来的十年,将是人类历史上最重要的十年。

在这十年里,我们必定会拥有超人AI!

不过细思恐极的一个问题是,AI实在是太耗水耗电了!

最近,ChatGPT耗电量惊人的话题,就上了微博热搜。

前几天流传的PDF曝出,OpenAI新模型Q*的参数很可能达到了125万亿。让我们算一算,如果AGI真的出现,一天要耗费多少电能?

此外,马斯克在最近一个公开采访中表示,芯片短缺缓解,限制AI发展的将是电力和降压变压器的短缺。

而获取高效清洁能源的方法,会直接影响AGI的到来。

Altman:AGI五年内实现

Sam Altman在一本讨论AI未来发展方向的书「Our AI Journey」中说到,AI将能完成 「营销人员、策略规划人员和创意专业人员95%的工作」。

(这本书采用订阅模式。新章节完成后就会发布)

他还说,AGI将在 「5年内成为现实」。

这本书收录了两位商业创新者Adam Brotman和Andy Sack对包括Altman在内的顶级人工智能领导者的深度访谈。

Brotman是Forum3的联合创始人和联合首席执行官,此前曾担任星巴克首任首席数字官。Sack也是Forum3的联合创始人和联合首席执行官,曾任微软首席执行官Satya Nadella的顾问。

他们之前的背景表明他们不是那种只会说空话的人。

Altman讲述的内容总是能刷新读者认识的上限。

Altman认为,「当AI能够独立完成创新的科学突破时,它就能被称为AGI了」。

两位作者想知道AGI将如何影响他们的工作:市场营销。

于是他们问Altman,AGI对那些想要通过创作广告活动来建立消费品牌的市场营销人员意味着什么?

这时,Altman抛出了他的第一个知识炸弹:

意味着营销人员今天使用代理公司、策略规划师和创意专业人员所做的95%的工作都将由人工智能轻松、近乎即时、几乎无成本地处理。

这一切内容都能做到免费、即时完成和近几乎完美可用。图片、视频、活动创意方案都没有问题。

而且AI很可能能够根据真实或合成的目标客户来测试创意,以预测结果并进行优化。

Altman称AGI即将到来

两位作者再继续追问Altman,你认为 AGI 将在何时成为现实?

Altman回答到:

5年左右,也许会稍长一些——没有人能说出一个确切的时间,也没有人知道它对社会的影响到底是什么。

这本书的作者Roetzer说,就算现在AGI还没有出现,人类就已经能看到经济、劳动力、教育和社会的大规模变革正在产生了。

就前不久,大型支付公司Klarna刚刚透露,它的AI助理现在已经能胜任700名员工的工作。

这个AI客服由OpenAI提供支持,处理客户的各种咨询,支持多语言,能够直接处理退款和退货的请求。

Klarna表示,在短短一个月内,AI助手就完成了700名全职客服的工作。

到目前为止,它已经进行了230万次对话,占公司所有客户服务对话的三分之二。

它的客户满意度得分与人工客服「不相上下」。

而且,它在解决客户请求方面更准确、更快速。解决请求的平均时间从11分钟降至2分钟。

Klarna的CEO暗示社会需要为先进的人工智能做好准备:

这凸显了人工智能将对社会产生的深远影响。

我们希望社会和政界人士对AI带来的影响有慎重考虑,并相信全面、透明的管理对于我们社会应对这场变革至关重要。

老黄:AI会在五年内通过人类测试,未来10年算力将再提高100万倍

老黄也同意这个观点,认为AGI将很快到来。

最近,英伟达CEO黄仁勋表示:AI会在五年内通过人类测试,AGI将很快到来!

在斯坦福大学举行的一个经济论坛上,黄仁勋回答了这个问题:人类何时能创造像人类一样思考的计算机?这也是硅谷的长期目标之一。

老黄是这样回答的:答案很大程度上取决于我们如何定义这个目标。

如果我们对「像人类一样思考的计算机」的定义,是通过人体测试能力,那么AGI很快就会到来。

五年后,AI将通过人类测试

老黄认为,如果我们把能想象到的每一个测试都列出一个清单,把它放在计算机科学行业面前,让AI去完成,那么不出五年,AI会把每个测试都做得很好。

截至目前,AI可以通过律师考试等测试,但是在胃肠病学等专业医疗测试中,它依然举步维艰。

但在老黄看来,五年后,它应该能通过这些测试中的任何一个。

不过他也承认,如果根据其他定义,AGI可能还很遥远,因为目前专家们对于描述人类思维如何运作方面,仍然存在分歧。

因此,如果从工程师的角度,实现AGI是比较难的,因为工程师需要明确的目标。

另外,黄仁勋还回答了另外一个重要问题——我们还需要多少晶圆厂,来支持AI产业的扩张。

最近,OpenAI CEO Sam Altman的七万亿计划震惊了全世界,他认为,我们还需要更多的晶圆厂。

而在黄仁勋看来,我们的确需要更多芯片,但随着时间推移,每块芯片的性能就会变得更强,这也就限制了我们所需芯片的数量。

他表示:「我们将需要更多的晶圆厂。但是,请记住,随着时间的推移,我们也在极大地改进AI的算法和处理。」

计算效率的提高,需求并不会像今天这么大。

「我会在10年内,将计算能力提高了一百万倍。」

马库斯泼冷水:GPT-5在2024年不会出现

一直唱反调的马库斯也做出了截止2024年底全新的预测——

我们可能会见证:

- 大约7到10款与GPT-4相当的模型问世

- 在技术上不会有革命性的突破(没有推出GPT-5,或者GPT-5并未达到预期)

- 市场上将出现激烈的价格竞争

- 几乎没有公司能够形成明显的护城河

- 尚无有效的方法来解决AI产生的幻觉

- 企业对这些技术的采纳将保持在一个适度的水平

- 利润相对适中,将在这7到10家公司之间分配

网友表示,还有11个月就能见证这个结果了。

为了证明自己的预测绝对影响力,马库斯还抛出了自己曾在2001年预测的模型幻觉问题。

以及两年前,2022年3月10日,曾发表了一篇「深度学习正在碰壁」的观点文章。

文章发表一个月后DALL·E问世,Sam Altman发文嘲讽,「请给我一个平庸的深度学习怀疑论者般的自信...」

而在今天,马库斯再次表示「即便过了2年,深度学习依旧面临同样的根本性挑战」!

也就是说,人类靠深度学习到达AGI,遥不可及。

https://garymarcus.substack.com/p/two-years-later-deep-learning-is?r=8tdk6&utm_campaign=post&utm_medium=web&triedRedirect=true

文中他列举了多个例证,来说明这些观点至今依旧成立:

- 深度学习从根本上说是一种识别模式的技术,当我们需要的只是粗略的结果时,深度学习就能发挥出最大的作用。

- 目前的深度学习系统经常会出现愚蠢的错误。

- 扩大参数规模的争论——那些已经扩大参数规模的研究,并没真正改进LLM迫切需要的东西——「理解力」。Kaplan等OpenAI团队所提出的衡量标准——关于预测下一个单词,并不同于AI就实现深度理解。

- 「scaling laws」仅是观察到的现象,就像摩尔定律一样,可能不会永远有效。

论文地址:https://arxiv.org/pdf/2001.08361.pdf

当然,马库斯最后表示,AGI并非不可以实现,而是人类需要一次范式转变。越来越多的结果说明,LLM本身不是通向AGI的终点答案。

与此同时,图灵巨头LeCun在最近的博客采访中,也谈到——AGI离我们还很远。

在这个访谈中,LeCun还提到了,「婴儿只有在已经了解了物质世界如何运作的基础知识之后,才能习得语言。很多物理知识都是内化的,无法用语言来描述,因此LLM也无法理解」。

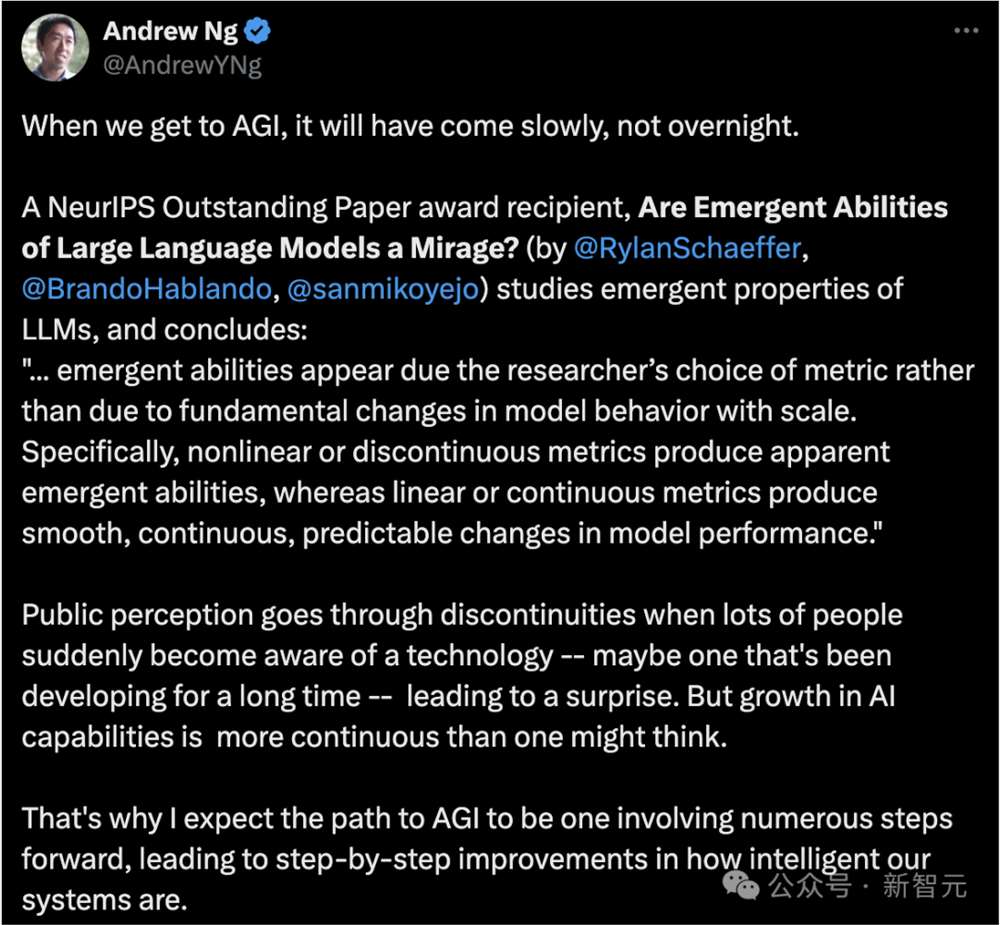

吴恩达也参与了AGI的讨论,并表示AGI只会慢慢到来,而非一夜之间。

斯坦福团队凭借「大模型涌现能力是海市蜃楼」获得NeurIPS杰出论文奖,论文中提到大模型涌现能力的出现是因为研究人员度量选择,而不是因为模型行为,随着参数规模变化而发现根本变化。

当许多人突然意识到一项技术(也许是发展已久的技术)时,公众的感知就会出现断崖式的变化,从而会纷纷感到惊讶。

但人工智能能力的增长,比人们想象的要持续得多。这就是为什么我预计通往AGI的道路将包括许多前进的步骤,进而让系统的智能化程度逐步提高。

ChatGPT耗电量惊人,人类撑得住AGI吗?

虽然AI模型已经在飞速发展,但最近的一个大问题已经让人揪心:它们实在太耗电了!

人工智能是能源的无底洞,AI未来将会被能源卡脖子。

包括Sam Altman在内的越来越多的AI行业大佬表示,AI的第一性原理,最重要的部分就是能源和智能的转化率的问题。

因为Transformer本质上不是一个能效很高算法,所以在未来,能源将会是困扰AI发展的一个大问题。

马斯克最近在一个公开采访中表示:

AI是有史以来最大的技术革命,我从未见过任何技术进步比现在的AI更快。

芯片短缺的情况可能已经过去,但人工智能和电动汽车正在以如此迅猛的速度扩张,以至于明年世界将面临电力和变压器的供应紧缩。

现在AI对算力的需求差不多每半年就会增加10倍。显然,这种情况不可能永远以如此高的速度持续下去,否则会超过宇宙的质量。

AI计算的瓶颈是可以预见的……一年前,短缺的是芯片。

然后下一个短缺将是电力。当芯片短缺缓解之后,明年可能就会出现电力将不不足以运转这些芯片。

然后,很容易预测下一个短缺将是降压变压器。

如果电网输出100-300千伏的电压,然后必须一路降压至6伏,那么降压幅度就很大。

这有一个不是那么好笑的笑话,未来运行Transformer的变压器(Transformer)将出现短缺。

Hinton:有1/10概率,AI会杀死人类

AGI真正实现那天,终结者中那一幕也在迫近。

「数字智能会取代生物智能吗」?

「几乎可以肯定,会的」!

「我们人类应该尽最大努力存活下来」。

AI教父Hinton近日在牛津大学发表了最新演讲,给出了惊人言论——在5-20年内,每个人都有1/10的概率被AI被杀死。

图灵奖得主Bengio也持有同样的观点,即有1/5的可能性,我们会被杀死。

Hinton意识到,日益强大的AI模型可以像「蜂巢思维」一样,相互分享所学知识,从而相对于人类更具优势。它们可能是一种更好的智能形式。

就比如,GPT-4可以学习语言,会推理、讽刺,还会展现出极高的同理心。

他在演讲中说,「我要做出一个非常有力的声明,这些模型确实能理解」。

这些模型也可能以危险的方式「进化」,形成一种控制的意向性。如果我为政府提供建议,我会说这些AI有10%的可能性会在未来20年内消灭人类。我认为这将是一个合理的数字。

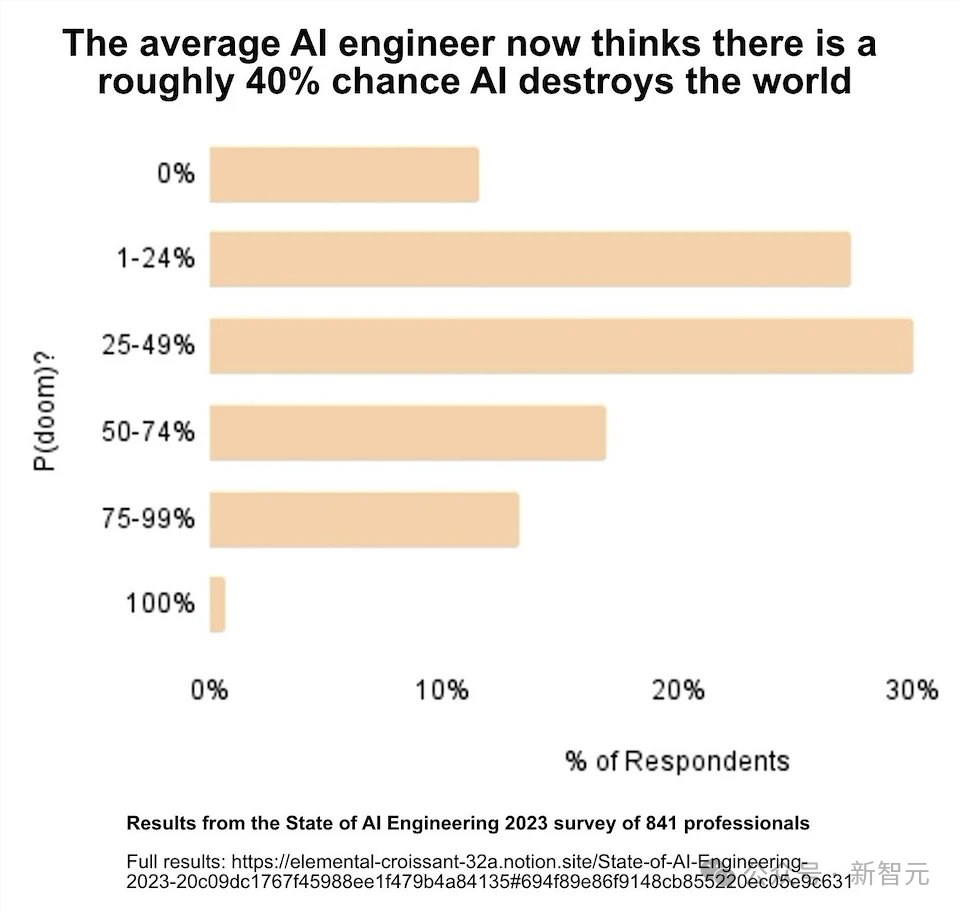

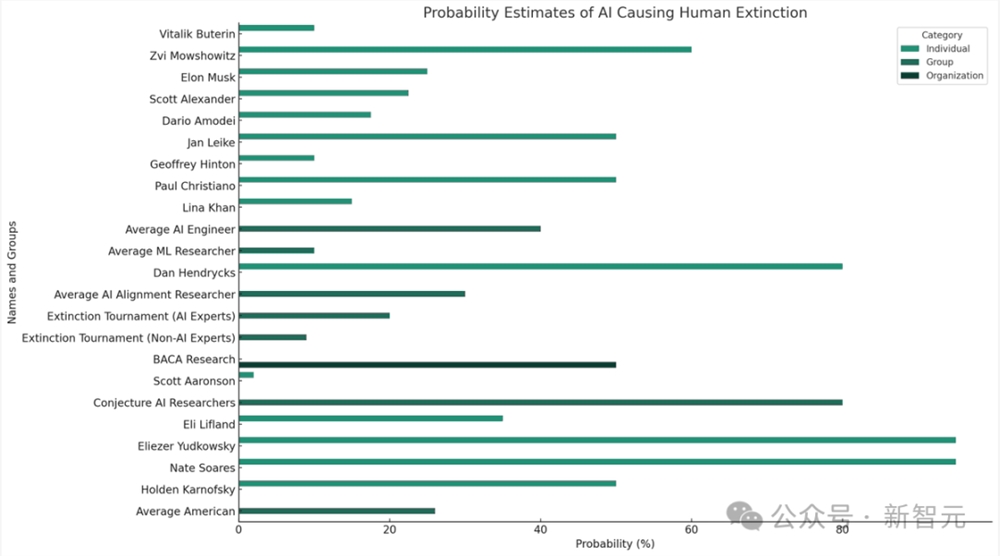

不仅如此,AI界大佬在「关于人工智能杀死所有人的可能性有多大」的问题时,认为有25-49%概率的人最多。

不同的人/组织对AI灭世的概率预测。

AI真的会杀死人类吗,你怎么看?

- 0000

- 0000

- 0002

- 0001

- 0000