AI应用的落地,会让智能手机迎来更大的内存吗

众所周知,对于如今的智能手机行业来说,“生成式AI”和“大模型”可以说是最新、最时髦的营销概念之一。

平心而论,这两项技术本身确实很先进,在不同厂商手中,它们也能够演化为各种或实用、或炫酷的功能。诸如从AI助手到“文生图”、到自动剪辑视频,再到通话同传翻译、录音自动提取关键信息,甚至是用生成式AI来进行美颜和增强长焦清晰度……

但这也不得不使得我们产生了另一个联想,那就是伴随着生成式AI相关功能在智能手机上的流行,它是否意味着未来的手机在内存大小上,将有望迎来一轮明显的升级呢?

小内存玩不转AI,这是很多人的共识

为什么我们会有这种想法?因为只要曾经在PC上尝试过AI绘图或AI视频处理的朋友想必都知道,现如今的端侧AI应用普遍非常“吃”内存,或者更准确一点说,是非常吃显卡的显存。

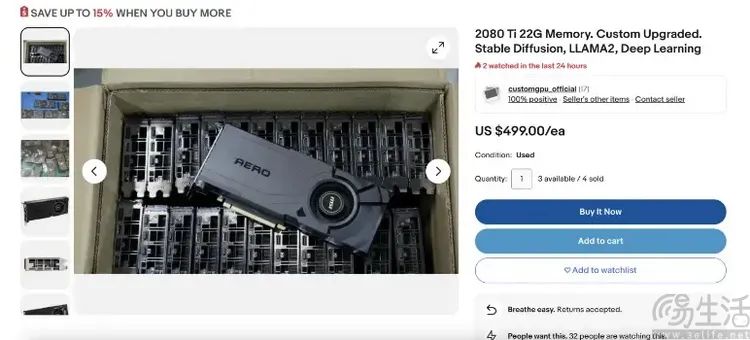

PC端AI绘图对于显存的超高要求,催生了RTX2080Ti22GB这种“魔改卡”

就拿PC上常见的AI绘图应用来说,4GB以上的显存通常才被认为是至少能够打开绘图应用的最低门槛。以我们的经验来说,大于12GB的显存,才能保障在中低分辨率(大约1000*1000大小)的大批量、高精度绘图过程中,尽可能减少“显存不足”报错的概率。

但众所周知,一方面对于目前的智能手机SoC来说,其GPU本质上使用的都是“共享显存”,也就是从内存中分出一部分来当作显存使用。

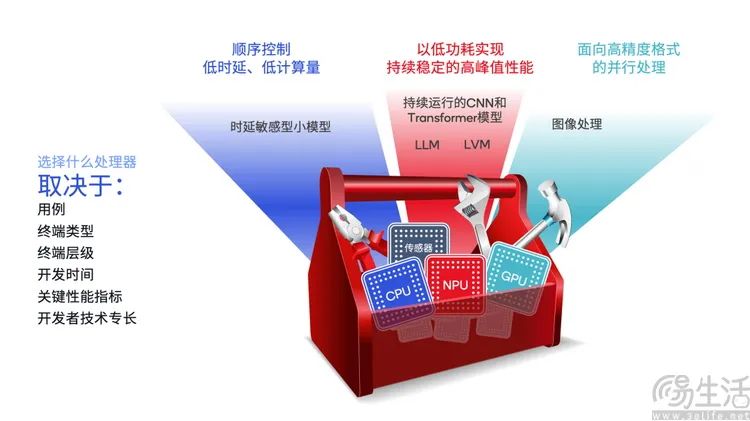

另一方面,根据公开的技术资料不难发现,对于当前手机的计算架构而言,其CPU和NPU其实都并不适合用于处理高精度、高分辨率的AI图像生成任务。因此在智能手机上如果要用AI绘图(这也包括生成式的拍照增强),那么就只能是调用GPU来进行,所以原理上就与PC平台的AI绘图相通,也就是必然需要用“大显存”来支撑。

而且此前我们三易生活已经通过实测证明,智能手机的“共享显存”是存在动态分配机制的。也就是说,同样品牌、同样型号的机型,内存更大的版本,GPU确实就会在执行重负载应用时分得更多的“共享显存”。

那么,这是否意味着手机内存会显著变大呢

然而很遗憾的是,从目前已知的相关信息来看,很可能并不会。

首先必须承认的是,现在已经有明确的、来自芯片厂商的说法可以证实,更大的内存有助于实现更高的AI性能,或者说有助于提升手机在运行端侧AI大模型时的灵活度。但“大内存”是不是就一定必须呢?其实并不一定。

一方面,这是因为内存的本质毕竟是处理器(图形处理器也算处理器)的“缓存”。既然是缓存,那么判断其效能就不能只看大小,还得结合带宽、甚至是处理器本身的性能水平来考量。

这并不难理解,因为当处理器的性能足够高、同时内存带宽也足够大的时候,实际上在处理数据的过程中,单位时间里需要“待在”缓存(也就是内存里)等待的数据量,实际上也就减小了。说得更直白一点,也就是在处理相同运算量的任务时,性能更高的机器对大内存的依赖就会更低一些,反而是性能不够的平台才会更需要更大的内存(以及显存)进行“兜底”。

另一方面,我们前面所举的例子都是AI绘图、是本地化的图像生成。但问题在于,端侧AI绘图本身就并非当下智能手机AI功能的主流方向。

比如说那些号称可以“文生图”的机型,其实很多都是使用云端算力来完成“绘图”过程的,也就是说它们其实并不依赖自己的GPU和内存来“硬算”。只有例如照片上的路人抹除、美颜等应用,手机才可能真正是在本地进行的AI运算。但这种基于已有图片进行美化、超分、小幅度修改的“AI绘图”,计算量还远没有“无中生有”来得大,所以也未必需要手机有很大的内存才能运行。

上游涨价 需求不足,超大内存时代可能没那么快

最重要的是,根据当下各方的相关信息显示,自2023年年底开始,内存和闪存行业就迎来了一轮显著的涨价潮。比如调研机构TrendForce就预计,2024年第一季度存储芯片的价格还将上涨大约20%。

当然,这倒不是说原材料价格涨了,手机厂商就一定会因此“不舍得”使用更大的内存了。可问题就在于大家都知道,2024年已经被公认为是全球智能手机行业复苏的关键节点,再加上端侧“生成式AI”至少在目前来看,并没有对内存大小产生很高的需求。

因此在成本上涨、同时(AI应用对内存)需求又不如预期般旺盛的双重作用下,新的“AI手机”继续沿用12GB内存来作为主流配置,同时将16GB和24GB当作少数机型的“锦上添花”选择,基本上也就成为了一个可以预见的结果。

- 0000

- 0003

- 0000

- 0002

- 0000