国内公司有望做出Sora吗?这支清华系大模型团队给出了希望

在 Sora 代表的视频生成路线上,国内公司其实已有一定的技术储备。

2023年年底,很多人都预测,未来一年将是视频生成快速发展的一年。但出人意料的是,农历春节刚过,OpenAI 就扔出了一个重磅炸弹 —— 能生成1分钟流畅、逼真视频的 Sora。它的出现让很多研究者担心:国内外 AI 技术的差距是不是又拉大了?

根据 OpenAI 披露的技术报告,Sora 的核心技术点之一是将视觉数据转化为 patch 的统一表示形式,并通过 Transformer 和扩散模型结合,展现了卓越的 scale 特性。无独有偶,最近发布的Stable Diffusion3也采用了同样的架构。

其实,这两项工作都是基于 Sora 核心研发成员 William Peebles 和纽约大学计算机科学助理教授谢赛宁合著的一篇论文《Scalable Diffusion Models with Transformers》。这篇论文提出了一种基于 Transformer 架构的新型扩散模型 ——DiT,用对潜在 patch 进行操作的 Transformer 替换常用的 U-Net 主干网络,把大语言模型的可扩展性、涌现性复制到了视觉任务上。

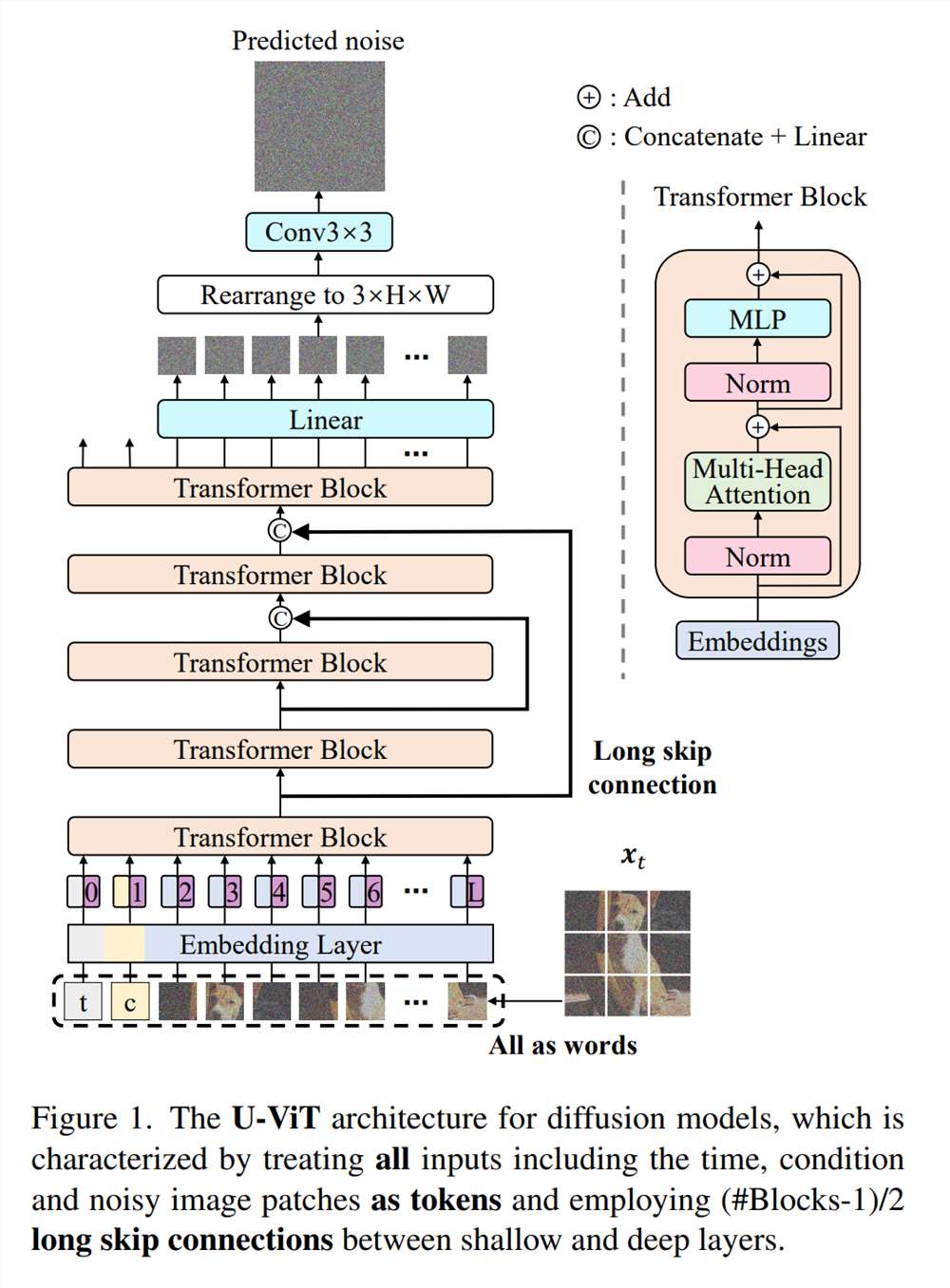

我们关注到,其实早在2022年9月,清华团队就提交了一篇名为《All are Worth Words: A ViT Backbone for Diffusion Models》的论文(比 DiT 早两个月)。这篇论文提出了用基于Transformer 的网络架构 U-ViT替代基于CNN的U-Net。对比来看,两项工作在架构路线上完全一致:均是提出了将 Transformer 与扩散模型融合的思路;并且在具体的实验路径上也一致,比如采用了相同的 patch embedding、patch size;都得出了同样的结论 ——patch size 为2*2是最理想的;在模型参数量上,两者都在50M-500M 左右的参数量上做了实验,最终都证实了 scale 特性。

不过 DiT 仅在 ImageNet 上做了实验,U-ViT 在小数据集(CIFAR10、CelebA)、ImageNet、图文数据集 MSCOCO 上均做了实验。此外,相比传统的 Transformer,U-ViT 提出了一项「长连接」的技术,大大提升了训练收敛速度。这篇论文后被 CVPR2023收录。

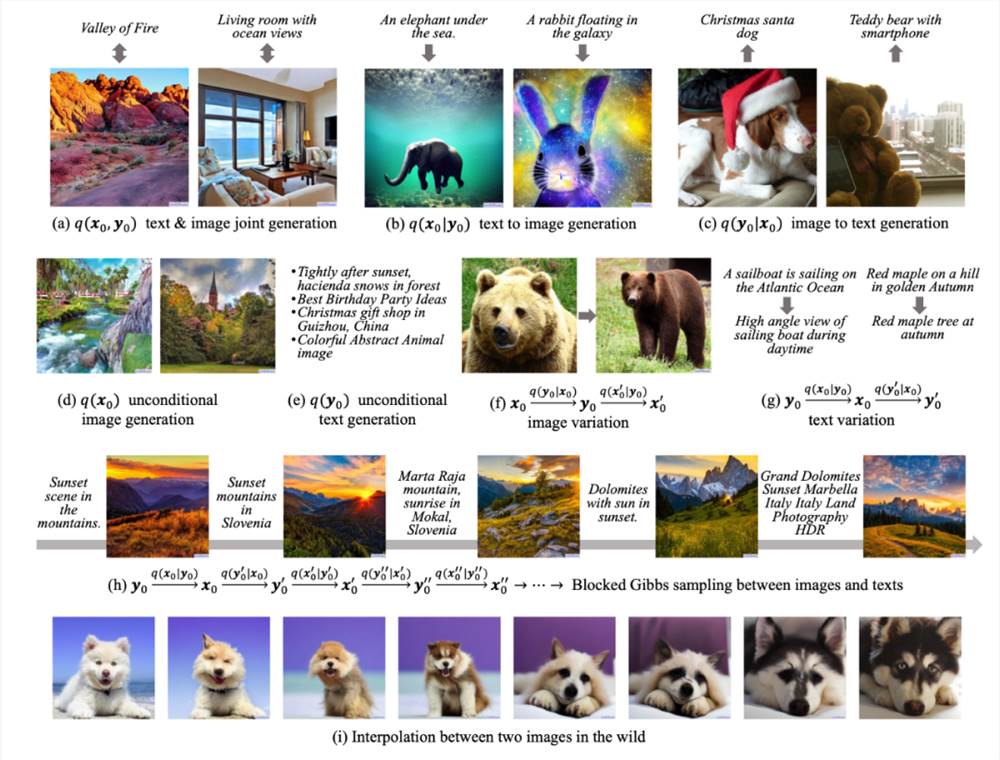

基于 U-ViT 架构,2023年3月,该团队再次发布了一项 UniDiffuser 的工作(参见《清华朱军团队开源首个基于 Transformer 的多模态扩散大模型,文图互生、改写全拿下》),在开源的大规模图文数据集 LAION-5B 上训练了10亿参数量的多模态模型。同一时期,主攻通用多模态大模型赛道的生数科技正式成立(参见《专访生数科技唐家渝:清华系团队拿到上亿融资,用Transformer来做多模态大模型》)。区别也在此刻发生,生数科技出于算力资源、技术成熟度等方面的考量,优先尝试将 U-ViT 应用于图文任务,而 OpenAI 则是利用其算力优势跨越式地直接将 DiT 应用于视频任务。

虽然主攻的任务不同,但 U-ViT 同样展示了在视觉任务下的优异能力。与当时同阶段的 SD1.5比较,UniDiffuser 效果是基本持平的。更重要的是,UniDiffuser 扩展性更强,能基于一个底层模型完成图文之间的任意生成。简单来讲,除了单向的文生图,还能实现图生文、图文联合生成、无条件图文生成、图文改写等多种功能。

Unidiffuser开源版效果

Unidiffuser当前效果图

有了这些对于架构的早期探索,生数科技其实在视频生成上颇具潜力,有望成为最接近 Sora 的中国团队。而且,他们也早已在视频生成方向进行了一些探索。

那么,未来的路怎么走?在视频生成这个问题上,有哪些棘手的问题需要解决?Sora 又将带来哪些商业机遇?在近期的一次访谈中,生数科技 CEO 唐家渝、首席科学家朱军向机器之心透露了自己的看法。

Sora 的出现比预期早半年

机器之心:首先想请两位回忆一下,第一次看到 Sora 的时候是什么感觉?有没有印象比较深刻的 demo?

唐家渝:我印象最深的是它的流畅性和时间长度。之前 AI 生成的短视频,大家都戏称为 GIF—— 变动小,视频短,只有几秒。Sora 生成的视频长得多,流畅度、自然度又明显好了一个层次,我觉得这是最直观的一个视觉上的冲击。印象比较深刻的 demo 是纸飞机那个场景:一堆纸飞机在森林里面飞,各个纸飞机还会撞在一起,还会跟树叶有一些互动。这本身是一个想象中的场景,但是生成效果逼真度很高,已经具有一定的物理规律的表现能力了。

朱军:如果回头看大家之前对视频生成长度的预判,Sora 的出现其实是超前了。之前能够预测到今年视频生成会快速发展,但当时在技术原理上,大家没有看到特别大的技术突破,所以当时就觉得短视频(几秒钟那种)会是一个主流形式。但 Sora 一下子做到了这么长,还是一个比较 surprise 的事情。原本预计今年年中或年底能做到这个水平,Sora 提前了大概有半年的时间。

用 Transformer 替代 U-Net 是一个自然想法,区别在于谁先做出效果

机器之心:最近关于 Sora 核心创新点的讨论比较多,而且大家提及最多的是它的架构。朱老师能否通俗地解释一下 Sora 的 Diffusion Transformer 架构是怎么一回事,「用 Transformer 替换常用的 U-Net 主干网络」有何必要性?

朱军:以视频数据为例,扩散模型的原理就是在数据上做加噪和去噪。这里很关键的问题,就是能不能准确地预测噪声,设计一个噪声预测网络。过去大家会用传统的 U-Net 去做,但是 Transformer 被证明在可扩展性等方面有很大的优势,所以用 Transformer 去替代 U-Net 是一个很自然的想法,区别就在于谁先做出来效果。

Sora 用到的 DiT 是2022年底发布出来的。其实早在2022年9月份,我们发布了一个叫 U-ViT 的模型。这个模型的主要思想是用 Vision Transformer 去替代 U-Net,和 DiT 核心的想法是一样的,就是用 Transformer 去增强扩散模型。这后来被证明非常有效,特别是在视觉数据的生成上。它一方面保持了扩散模型的优势,另一方面又利用了 Transformer 的可扩展性以及对不同模态的兼容性。相比于传统的 Transformer,我们自己的设计(U-ViT)里面还包括了长连接,它可以让计算效率变得更高,能看到很显著的效果提升。

U-ViT 架构

机器之心:我们可以从哪些指标上看到这些效果?

朱军:其实在22年的时候,大家就已经看到了,用 Vision Transformer 这种架构可以提高生成质量,实现更高的分辨率,也可以更有效地训练更大规模的模型。现在,我们可以看到更多的例子,包括 Sora、Stable Diffusion3。这些例子一次又一次地证明了,这个架构的潜力是巨大的。

机器之心:在生数的产品里面,这份工作展现出了什么样的效果?

朱军:我们从一开始就坚持用扩散加 Transformer 的融合架构,也就是多模态原生的架构。之前,很多团队在做多模态的时候,会想说什么模态都对到语言上。但我们认为这种架构不是最优,因为从原理和计算效率上来看,这种方法存在天然的不足,所以从一开始我们就在走扩散加 Transformer 这种路线。

2022年我们提出 U-ViT 架构的时候对标的是 Stable Diffusion,当时 Stable Diffusion 刚开源。所以在 U-ViT 架构的基础上,我们又在2023年3月份开源了一个叫 UniDiffuser 的大模型。这个模型也是基于扩散加 Transformer 的融合架构,可以在文、图两种模态之间进行任意的转换。

从底层架构的训练到优化到支撑上层的图像、3D、视频的生成,生数一直在坚持这个架构,一直在坚持这种融合的路线。

机器之心:您的意思是说,这种融合的路线相比那种单纯地用 Diffusion 或者单纯地用 Transformer 效果都要好,是吗?

朱军:是的。与单纯地用 Diffusion 相比,融合架构的主要优势就是 Transformer 的可扩展性。与单纯地用 Transformer 相比,融合架构在生成视觉数据的效率,包括模型的表示效率和计算效率等方面有很大的优势。

对于 Transformer 这个架构来说,你把所有东西都放到里边,好处就是简单直接。但是,就目前对视觉数据的处理和生成效果来看,扩散还是占优势的。在我们看来,融合模型更符合原生多模态的定位。因为不同类型的数据,它的特点是不一样的,所以应该针对不同模态选择最合适的一种处理方式。从实际的视觉生成效果来看,现在主流的方法也是用扩散模型去做生成,因为用 Transformer 这个架构直接去做生成的话,到目前为止效果还是落后的。

机器之心:你们的 U-ViT 和 DiT 是同一时期提出的,但是你们选择优先用它去做图文任务,而不是视频生成,是基于什么考量?

朱军:实际上我们也在做视频生成,只是当时基于算力的考虑排了一个优先级。这里面也有我们基于技术成熟度的一个预判。去年,我们是优先从2D 的图像开始,然后紧接着到5月份的时候,我们就做了3D 生成(从2D 到3D),后来我们又做了视频和4D( 参见《一键实景转动画,清华系初创公司全球首发4D骨骼动画框架》)。实际上就是在有了基础的基座之后,我们可以做不同维度的扩增,3D、4D 其实分别是空间、时间上的一个扩展。

视频实际上是图像的流,它相当于在时间轴上做了一个扩增。所以我们的架构实际上可以很自然地支持短视频的生成,只是当时我们主要聚焦在几秒钟的短视频的生成,没有像 OpenAI 的 Sora 那样一下子做到几十秒、一分钟。这里边有很多原因,但其中一个很重要的原因是,我们手头的资源相对来说确实受限很多。但是,从2D 图像到视频生成,很多东西是一脉相承的,很多经验(比如大规模训练的经验)是可以复用的。

复现 Sora,还有很多难题需要解决

机器之心:生成几秒的视频和1分钟的视频之间的技术差异是巨大的。根据您的经验,除了算力,做到这一点的关键是什么?

朱军:这里面很重要的一块是,针对比较长的视频,怎么有效地表示它的时空信息,怎么有效地去压缩视频数据,学到一个嵌入的表示,然后在上面再去做扩散、生成。

另外,要让这种架构能够有效训练,数据也很重要。基于之前的 DALL・E3等积累的优势,OpenAI 可以对视频数据做到比较有效的语义理解。这在训练数据里是非常关键的。因为在创作的时候,你输入的语言通常是比较有限的、简单的,所以如果想去生成丰富的视频内容,中间需要一个比较强的语义理解过程。

当然,可能还有很多我们不知道的因素。Sora 的成功不光是一个生成的问题,里面包括语义理解、数据标注、数据清洗、大规模训练以及工程优化等等。这些问题如果没有做过是不知道的,由于 OpenAI 做过很多成功的案例,所以他们做成一个新项目的成功率会更高。

机器之心:同样的架构用来做图像任务和视频任务,会有什么不同吗?对生数团队而言,下一步计划如何将该架构从图像任务拓展至视频任务?

朱军:主要的不同在于,视频里面包含很多的时空信息。怎么抓住里面关键的运动、保持住长时间的一致性?这是单张图片不会涉及到的。二者从原理上来说是相通的,我们从去年下半年开始也一直在做视频相关的工作。

生数底层拥有自主训练的架构,所以在上面我们能够很自然地做各种生成。图像生成是一个基础,图像生成的质量会影响到视频生成的质量。此外,3D 生成我们也持续在做。只是,Sora 比我们预期出现得要早,所以后续我们会加强视频生成这一块。

打造通用多模态,需要通用架构提供支撑

机器之心:Sora 的发布让我们看到 OpenAI「all in AGI」的野心。他们的技术路线有两个关键点:一是多模态,二是通用化架构。生数科技也是「通用多模态路线」的坚持者,在您看来,通用化架构有何必要性?

朱军:如果想让模型实现更强的通用性,就需要更加通用的模型架构来支撑。以 Sora 为例,在架构上它肯定要融合文字和视觉数据。换句话说,如果你只做视觉或只做文本的话,你在多模态的任务上就不是最优,或者说有些模态不能处理。这是一个很直接的相互支撑的关系。

机器之心:做这种通用架构的难点体现在哪几个方面?

朱军:难点就在于,不同模态的数据,特点是不一样的,你是不是直接简单粗暴地用一种方式表示所有数据?这种方式目前来看可能并不是最优,所以需要针对不同数据的特点去分析考虑。另外,不同模态的数据,它的数据量是不一样的,或者说不均衡。在训练过程中,这可能会对你的优化过程产生实际的影响。还有不同模态之间的对齐理解也是问题。

机器之心:Sora 出现后,有种声音说,国内外的差距进一步拉大了,您怎么看待这个问题?

朱军:差距是否拉大,这是一个可以辩论的问题。但我觉得,Sora 出来之后,国内外并没有像当初 ChatGPT 出来时那样形成很明显的代差。只是大家现在在工程技术上可能会落后一些。视频生成这个问题,国内也很重视,而且国内做图像、视频相关任务的基础还是比较好的。从当前的结果来看,实际情况可能比想象中要乐观一些。

来自 OpenAI 的启发:

技术自信和资源都很重要

机器之心:如果从商业和产品的角度来看,您如何看待 Sora 的成功?

唐家渝:OpenAI 整体的模式是朝着 AGI 的目标,从底层模型能力提升的层面不断地往前跑,模型本身就可以看作是他们最核心的产品。据说 Sora 这个小组也并没有去考虑太多关于商业和产品的事情,所以可能他们在最开始的时候主要还是聚焦在如何实现真正好的视频生成能力,然后去相信说只要我有这么强的能力,上面一定能搭出更多的商业化产品。对外赋能底层 API 的能力,然后在上层去创建一个繁荣的 AI 生态,是 OpenAI 已经验证成功的一种商业模式了。

从这个维度来讲,我觉得他们成功因素中很重要的一点已经写在了他们公司的价值观里,也就是所谓的 “Scale”,他们整个公司都是相信 scale up 的,官网原话是「如果对此产生了怀疑,就进一步 scale it up」。所以我觉得这也是他们对于自己的技术路线的充分自信和坚持,然后衍生出了现在的成功。

机器之心:这对生数科技有什么启发?

唐家渝:首先是观念上的。我觉得我们在设计了 Diffusion 融合 Transformer 这样一个好的架构,并且已经看到它有巨大的潜力的情况下,应该要更有技术上的自信。这和 OpenAI 去相信 scale up 是类似的。

第二点是,在有自信的同时,如果你要去做 scale up,尤其是基于视频数据,就要去卷入更多的资源。因为像我们或者国内的其他创业公司,其实相比 OpenAI 所拥有的资源还是差很多的。所以我们得敢想敢做地去卷入更多资源,和更多资源方去合作,这样才能把技术自信转变为技术实现,然后变成产品实现。

视频生成:生数的过去与未来

机器之心:生数之前上线过一些文生视频的能力,可以介绍一下之前的探索工作吗?

唐家渝:我们的技术探索最终是为产品服务的。从产品层面来看,我们之前发布的能力和业界是差不多的,就是几秒的短视频生成和编辑。那个时候主要受限于算力等因素,没有利用已有的架构在视频数据上去完成 scale up。从产品使用角度来看,我们其实看到这种几秒的视频已经能够帮用户去做一些创意的工作,即使要制作长视频,其实也可以通过设计脚本来拼接短视频实现。

但 Sora 的出现让我们看到,原生长视频生成的能力不仅从内容创作的角度,可以帮助我们去进行长镜头等更加艺术化的表达,也能外显出一定的物理世界理解能力,使得生成的视频更加自然。这也大大增强了我们加大视频生成研发投入的信心和决心。

此外,我们之前的这些探索其实也是为了牵引内部的一些工程基础建设,比如为视频数据的收集、清洗、标注以及模型的高效训练积累经验。这些积累和最接近Sora的架构,使得我们在做长视频生成时,对最终的效果更加抱有期待。

机器之心:据您所知,Sora 的开发、应用成本有多高?如果要做类似产品,生数要如何应对随之而来的成本问题?

唐家渝:就开发成本来说,业界估计资源比较充分的状态需要达到万卡(英伟达 A 系列)的水平。由于我们之前在大规模训练上做了很多加速的工作,所以我们的需求实际评估下来会少一些。

如果估算一下 Sora 的应用成本,目前生成60秒的高清视频大概需要几块到几十块人民币。所以 OpenAI 现在还没有完全放出来这个东西,估计也是有算力、成本方面的顾虑。此外,模型生成视频的成功率也是未知数,这可能也是一个顾虑。

要降低应用成本,肯定要在这个过程中做一些模型压缩的工作,包括一些分布式的操作 —— 比如在手机、笔记本端去做一些推理,也会是大家去做的一个衍生方向。另外,架构层面的一些优化肯定也会持续去做。所以应用成本的问题,我们觉得相对来说还是比较乐观的。

什么叫「原生多模态模型」?

机器之心:根据您公司的描述,你们走的是「原生多模态大模型」赛道,能否介绍一下这个赛道和其他赛道的区别,以及该赛道国内外玩家的具体情况。

唐家渝:其实定位原生多模态这个赛道是说,我们从第一天就坚持做一个完整的通用多模态大模型,而不是训练多个模型,对这些模型的能力做排列组合式的使用。我们的做法是从底层的架构出发,天然地去考虑通过一个模型支撑不同数据的输入输出,它的特点是模型学到的知识会更加充分,而且在使用的时候,不用调用不同的模型去做组合应用,因此推理效率会更高。

举个具体的例子,GPT-4支持文本-文本,DALL·E3支持文本-图像,GPT-4V可同时输入文本和图像,但输出仅文本,在应对开放的视觉任务时,是通过调用DALL·E3或者GPT-4V的接口来实现,而原生的技术路线是基于一个底层架构实现「GPT-4V DALL·E3」的统一,能应对广泛开放域的文本和视觉交互类的复杂场景。

这个领域的国外玩家主要是谷歌(Gemini)和 OpenAI(Sora)。国内的话,我们是最早、也可能是唯一坚持做通用性的多模态大模型的公司。

机器之心:从产品的角度,您如何定义「原生」?

唐家渝:从产品角度来看,其实我们更多的是考虑有了原生多模态模型的加持之后,产品所带来的用户体验有没有指数级的提升,像「所想即所得、所说即所得」就是一种指数级的提升。我们所做的事情,无论是图像、3D 还是视频的生成,其实都是朝着这个目标在努力的。就是让一个即使没有任何专业能力的人,都可以去创作出他想要的画面,或者说在数字世界或物理世界具象化出想象中的某个东西。我个人心中的标准之一就是,自己的亲戚朋友最终会不会喜欢去用这么一个产品。

Sora 所带来的商业机遇

机器之心:在关于 Sora 是否理解物理世界的争论中,Keras 之父 François Chollet 曾提到,这个问题之所以重要,是因为它决定了生成图像、视频的应用范围 —— 是仅限于媒体生产,还是可以用作现实世界的可靠模拟。如果分两种情况去讨论,Sora 的发布将分别带来哪些新的商业机遇?

唐家渝:我觉得前者主要对应的是数字世界里的内容生产。在数字世界中,我们平时接触到的内容涉及电视电影、广告、教育、社交娱乐等多个行业。因为视频形态在我们日常生活中用得太多了,所以即使只看跟视频相关的场景,它的应用前景就已经非常不可限量了。

如果它能理解物理世界,那应用范围就不止局限在数字世界了,而是可以和物理世界产生交互。比如,它可以和机器人结合实现具身智能,也可以用于自动驾驶,用于数字孪生。之前一个一个构建小模型的方法可能有很多 corner case 照顾不到,如果模型真能了解到物理世界的规则,我们就能使用一个通用模型来处理所有的关于物理世界的认知和仿真任务,这可能会极大地推动社会运行方式的进化。

- 0000

- 0000

- 0003

- 0000

- 0000