Meta开发AudioSeal技术,可以秘密为 Deepfake 音频添加水印

**划重点:**

1. 🌐 Meta的研究人员开发了一种方法,在人工智能生成的语音中隐形水印,可用于主动检测AI生成的言论,识别生成它的模型。

2. 🚀 Facebook Research提出的AudioSeal技术通过水印标记AI生成的语音,以解决对抗合成语音的检测问题,具有高精度和鲁棒性。

3. ⚠️ 虽然AudioSeal是一项重要进展,但仍需谨慎应用,以克服隐私和伦理风险,同时也强调需要不断演进的解决方案以确保对抗合成媒体的可靠性和合法性。

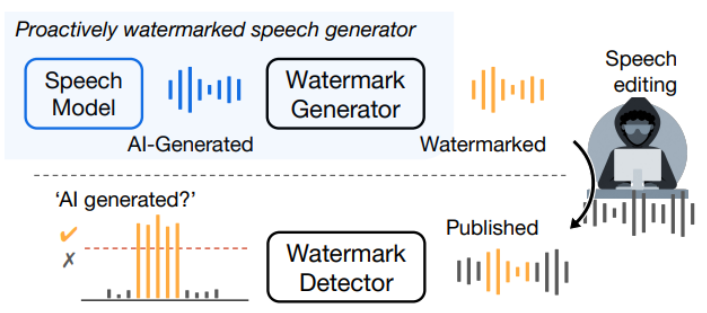

近期,Meta的研究人员在对抗合成语音的挑战中取得了一项重大突破。他们提出了一种名为AudioSeal的技术,该技术能够在人工智能生成的语音中嵌入隐形水印,用于主动检测AI生成的言论,同时还能够识别生成它的具体模型。

人工智能语音合成技术的迅速发展使得虚构的人类语音变得极为逼真。然而,这也引发了对声音克隆、深度伪造和其他形式的音频操纵的担忧。为了有效区分真实录音和音频深度伪造,需要强大的新型检测方法。在这篇文章中,我们将介绍来自Facebook Research的一种新颖技术,名为AudioSeal,它通过在AI生成的语音中嵌入隐形水印来解决这一问题。

传统的检测虚构音频的方法通常采用被动分析,即训练分类器识别真实和合成语音之间的统计差异。然而,随着合成系统变得越来越先进和自然,被动检测在未来可能会变得不够可靠。因此,需要采用主动水印技术,直接在AI生成的音频中嵌入信号。

AudioSeal具有两个关键组成部分:生成器和检测器。生成器将隐形水印嵌入由语音合成模型产生的音频中,而检测器则分析音频剪辑,精确定位包含水印的区域,从而识别AI生成的部分。

与先前的音频水印技术相比,AudioSeal在多个方面取得了显著的改进。它具有广泛适用性,只需训练一次即可适用于任何模型或语言,实现了对模型身份消息的扩展,同时保持高鲁棒性。此外,其高效的检测速度使其在实时和大规模筛查方面表现出色。

然而,尽管AudioSeal具有令人期待的优势,对其负责任的应用仍需谨慎。该技术依赖于保持检测器的机密性和对抗不同攻击的鲁棒性,以防止恶意行为者识别并移除水印。此外,水印技术可能涉及一些伦理风险,如大规模监控,因此可能需要跨不同供应商标准化,以避免竞争升级。

AudioSeal是解决检测AI生成音频挑战的一项创新技术。通过隐形水印合成语音,AudioSeal提供了局部检测,即使合成模型快速演进,也能保持高度鲁棒。然而,随着威胁形势的变化,更好的解决方案仍需要不断发展,以识别操纵风险并在人工智能能力不断增强的背景下建立对语音界面的信任。

- 0000

- 0001

- 0000

- 0000

- 0000