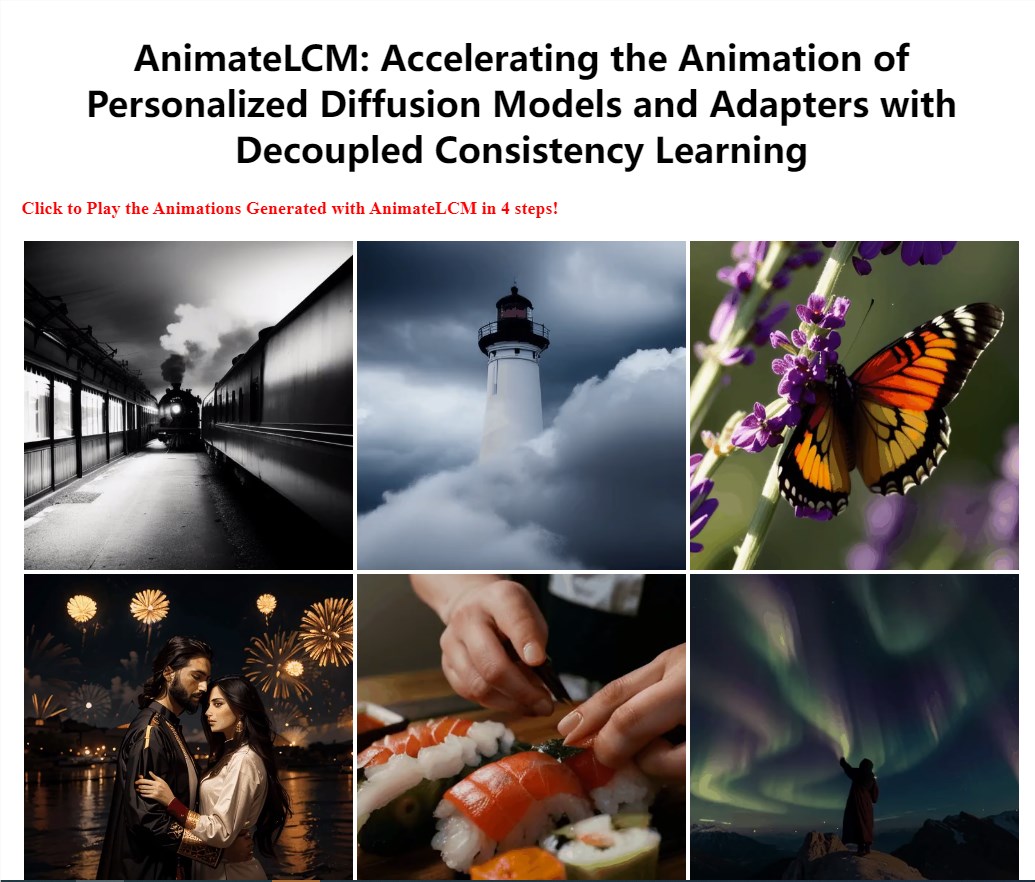

支持Animatediff所有控制方式!AnimateLCM 4步推理即可生成视频

站长网2024-02-02 17:06:311阅

又有团队开卷视频生成了!这个项目在视频生成方面非常优秀。它使用了一致性模型(Consistency Model, CM)的启发,简化了预训练的图像扩散模型以加速采样过程。这一模型还成功扩展到了潜在一致性模型(Latent Consistency Model, LCM),用于条件图像生成,最终形成了AnimateLCM。

项目地址:https://top.aibase.com/tool/animatelcm

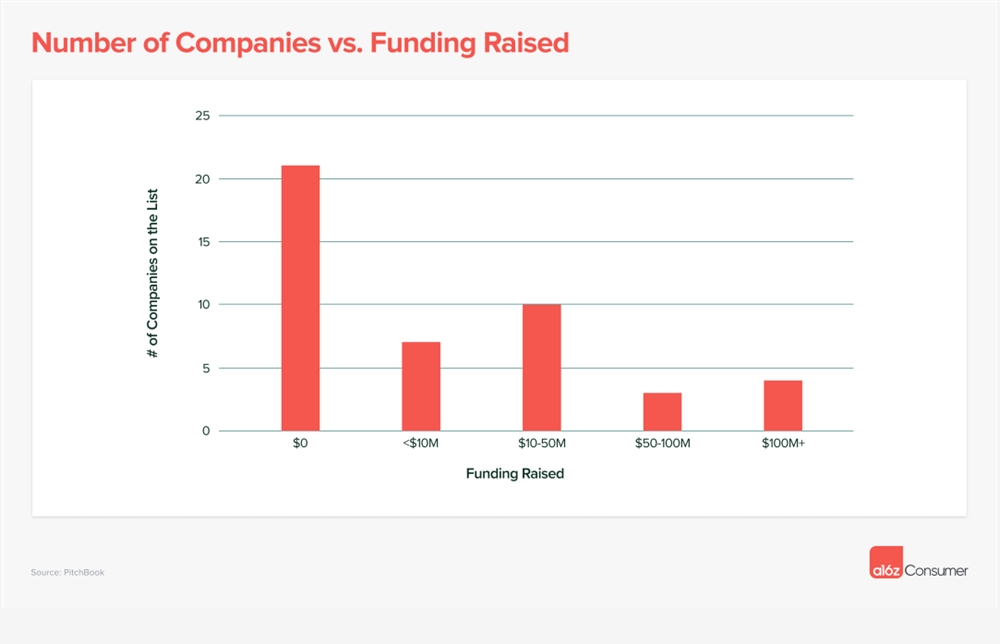

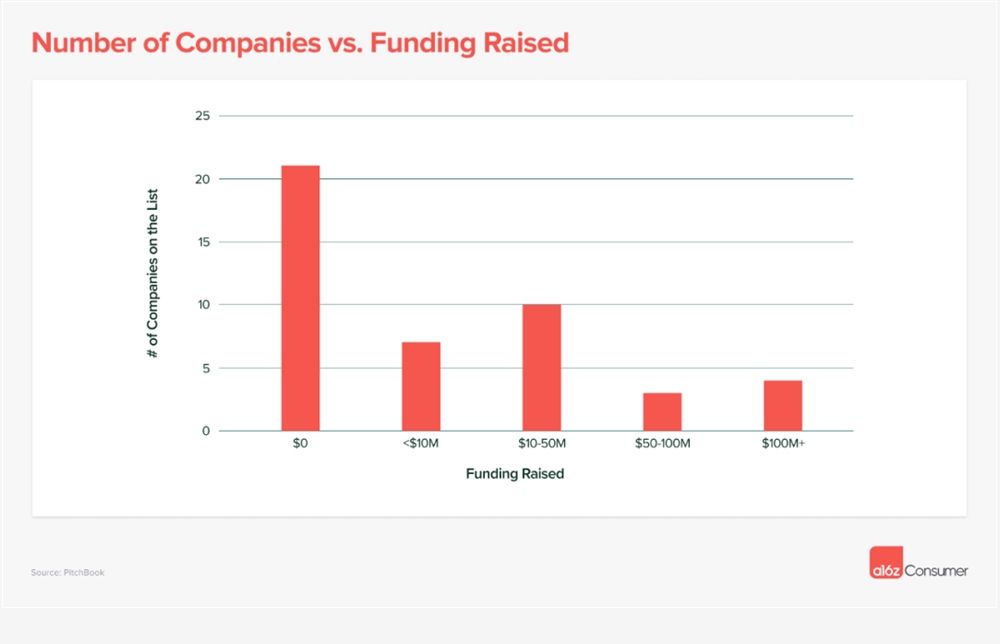

AnimateLCM能够在很少的步骤中生成高质量的视频。相比直接在原始视频数据集上应用一致性学习,该项目提出了一种解耦的一致性学习策略,分别对图像生成的基础知识和运动生成的基础知识进行提炼。这种策略提高了训练效率并提升了生成视频的视觉质量。

此外,为了结合稳定扩散社区中的即插即用适配器来实现各种功能,比如使用ControlNet进行可控制的视频生成,该项目提出了一种高效的策略。这个策略不仅可以将现有的适配器调整到文本条件视频一致性模型中,还可以从零开始训练适配器,而不会影响采样速度。

在基于图像的视频生成和基于布局的视频生成中,AnimateLCM都取得了优异的成绩。从演示来看视频效果也很不错,支持现有 SD 生态 Animatediff 的所有控制方式,将LCM用在视频生成只需要4步推理就可以生成视频。目前,AnimateLCM暂未发布代码和权重,期待能够尽快上代码。

0001

评论列表

共(0)条相关推荐

- 0000

- 0000

- 0000

- 0001

- 0000