MiniMax 发布国内首个 MoE 大语言模型 abab6

站长网2024-01-16 17:05:270阅

MiniMax 在2024年1月16日全量发布了大语言模型 abab6,这是国内首个采用 MoE 架构的大语言模型。

MoE 架构使得 abab6具备处理复杂任务的能力,并且在单位时间内能够训练更多的数据,提高计算效率。相比于之前的版本 abab5.5,在处理更复杂、对模型输出有更精细要求的场景中,abab6有显著的提升。

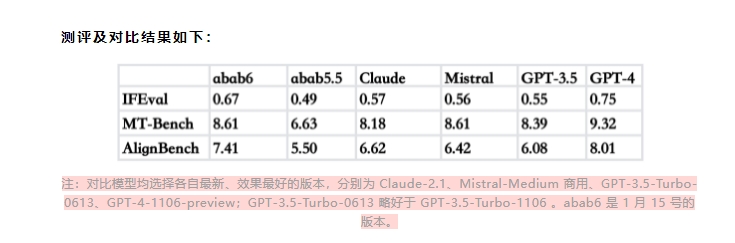

为了验证 abab6的性能,MiniMax 进行了自动评测。评测结果显示,abab6在指令遵从、中文综合能力和英文综合能力上均优于之前的版本 abab5.5,也明显超过了 GPT-3.5。与其他大语言模型如 Claude2.1和 Mistral-Medium 相比,abab6在多个测试集上也表现更好。

在实际应用中,abab6展现了出色的能力。例如,它可以用一个有趣的方式教授儿童数学题目,同时模拟海绵宝宝的口吻来增加孩子们的学习兴趣。此外,abab6还可以帮助构建一个关于上海的虚构桌游,包括上海的旅游景点、历史文化和美食等元素,让玩家更好地了解上海。

总结起来,abab6作为国内首个 MoE 大语言模型,具备处理复杂任务的能力,并在指令遵从、中文综合能力和英文综合能力上表现优异。通过与其他模型的对比和实际应用案例,abab6展现出了出色的性能和潜力。

用户可以访问 MiniMax 开放平台官网来申请试用 abab6大模型。

体验地址:https://api.minimax.chat/

新鲜AI产品点击了解:https://top.aibase.com/

0000

评论列表

共(0)条相关推荐

- 0000

- 0000

- 0000

- 00012

- 0000