AI圈头条!谷歌Transformer开山论文惊天「翻车」

站长网2023-05-10 10:02:271阅

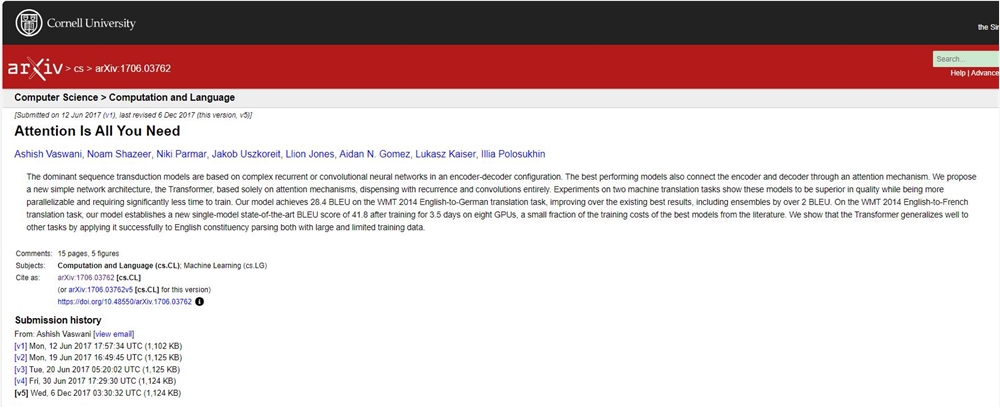

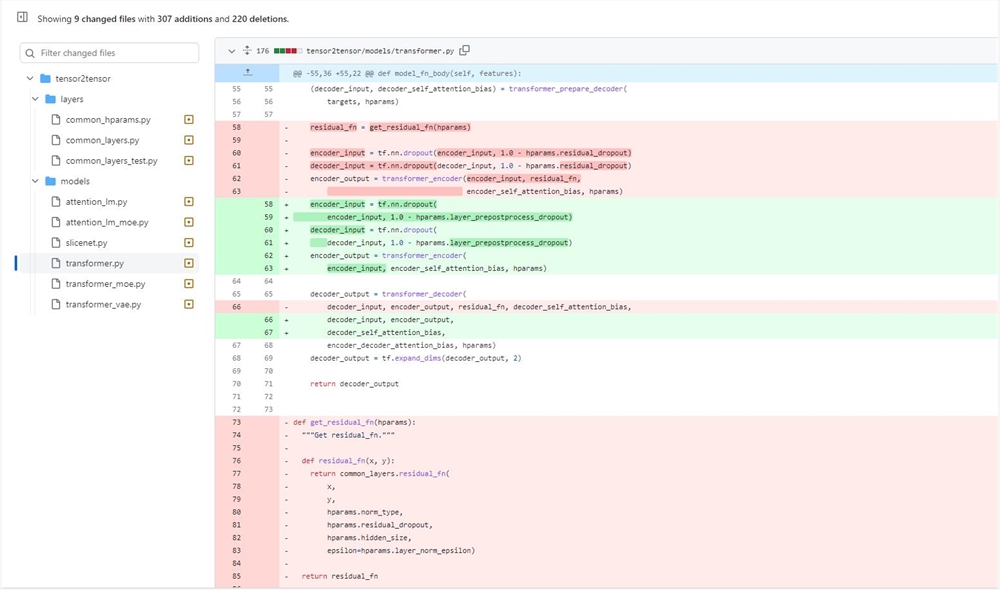

AI圈大头条!谷歌大脑的NLP奠基之作、提出Transformer架构的开山鼻祖级论文 《Attention Is All Your Need》竟然出现图与代码不一致的问题。

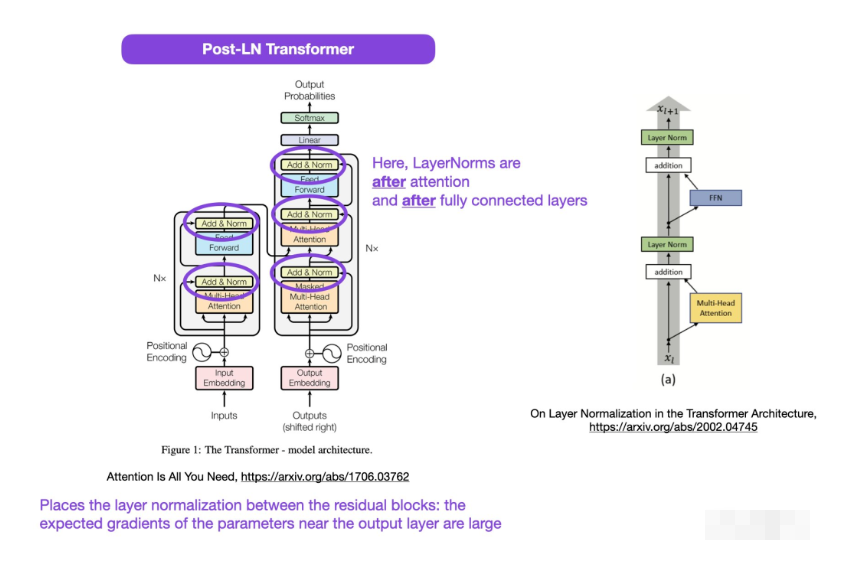

今天,谷歌的开创性论文《Attention Is All Your Need》中变压器架构的原始图表被发现是不正确的,LayerNorm处于错误的位置。然而,一篇新论文表明,将Pre-LN和Post-LN结合起来可以解决梯度爆炸和消失的问题。

论文地址:https://arxiv.org/abs/1706.03762

代码地址:

https://github.com/tensorflow/tensor2tensor/commit/f5c9b17e617ea9179b7d84d36b1e8162cb369f25#diff-76e2b94ef16871bdbf46bf04dfe7f1477bafb884748f08197c9cf1b10a4dd78e

据悉,Transformer架构是人工智能的基石,自2017年发表以来,该论文已被引用超过7万多次。在图表中发现错误引发了对该领域其他开创性论文准确性的质疑。

图中的错误可能导致转换器体系结构的不正确实现,这可能会影响使用它构建的模型的性能。

关于使用Pre-LN还是Post-LN的讨论正在进行中,新论文中提出的两种方法的结合可能会导致人工智能模型开发的进一步发展。

0001

评论列表

共(0)条相关推荐

- 0000

- 0000

- 0000

- 0000

- 0000