阿里团队推新AI模型I2VGen-XL:单张静止图像就能生成高质量视频

视频合成最近取得了显著的进步,这得益于扩散模型的快速发展。然而,它在语义准确性、清晰度和时空连续性方面仍然存在挑战。它们主要源于文本-视频数据的稀缺性和视频的复杂固有结构,使得模型难以同时确保语义和定性的卓越性。

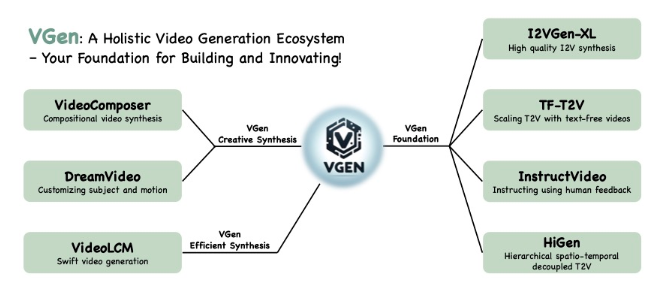

阿里巴巴、浙江大学和华中科技大学的研究人员提出了一种级联的 I2VGen-XL 方法,该方法通过解耦这两个因素来增强模型性能,并通过利用静态图像作为关键指导形式来确保输入数据的对齐。

项目体验网址:https://top.aibase.com/tool/i2vgen-xl

I2VGen-XL 由两个阶段组成:

i) 基础阶段通过使用两个分层编码器来保证连贯的语义并保留输入图像中的内容。

ii) 细化阶段通过合并额外的简短文本来增强视频的细节,并将分辨率提高到1280x720。

目前文本到视频合成的主要挑战之一是高质量视频文本对的收集。为了丰富 I2VGen-XL 的多样性和鲁棒性,研究人员收集了一个庞大的数据集,其中收集了大约3500万个单镜头文本-视频对和60亿个文本-图像对来优化模型。通过这种方式,I2VGen-XL可以同时提高语义的准确性、细节的连续性和生成视频的清晰度。

所提出的模型利用潜在扩散模型(LDM),这是一种生成模型类,可以学习扩散过程来生成目标概率分布。在视频合成的情况下,LDM逐渐从高斯噪声中恢复潜在目标,保留视觉流形并重建高保真视频。I2VGen-XL采用LDM(简称VLDM)的3D UNet架构,以实现有效且高效的视频合成。

细化阶段对于增强空间细节、细化面部和身体特征以及减少局部细节中的噪声至关重要。研究人员分析了频域细化模型的工作机制,强调了其在保留低频数据和提高高清视频连续性方面的有效性。

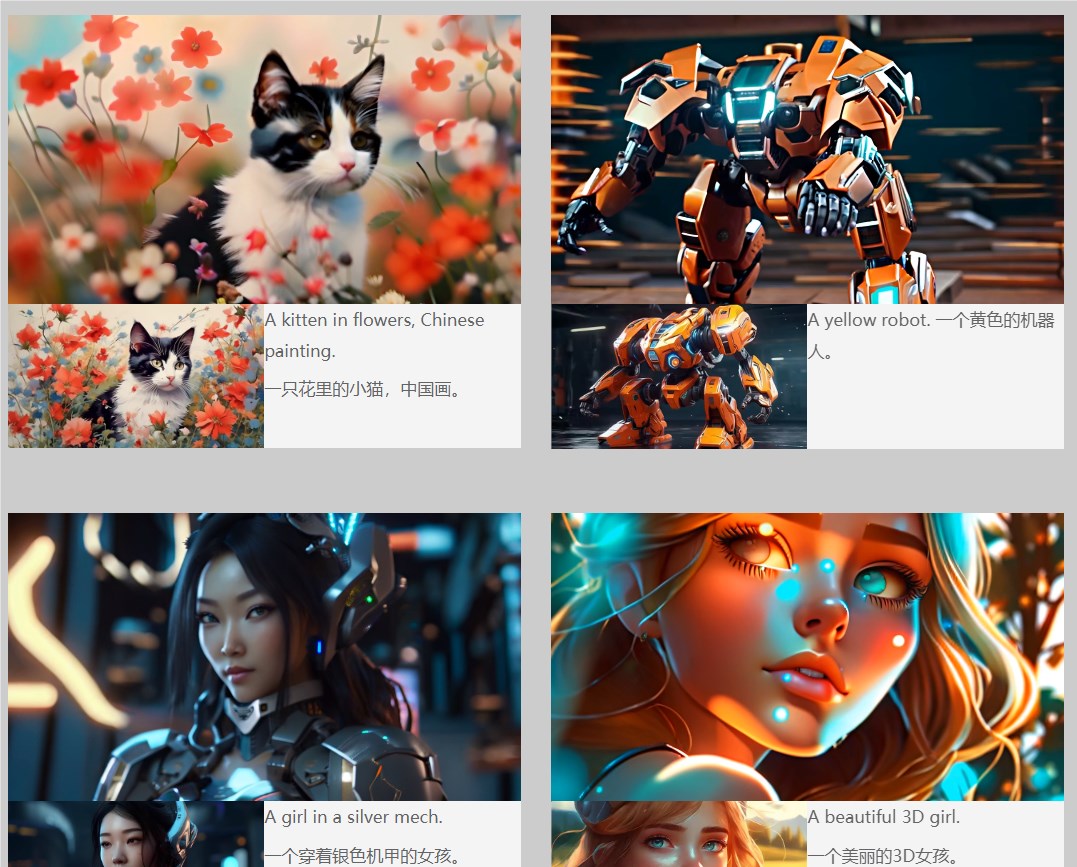

在与 Gen-2和 Pika 等顶级方法的实验比较中,I2VGen-XL 展示了更丰富、更多样化的运动,强调了其在视频生成方面的有效性。研究人员还对人脸、3D卡通、动漫、中国画、小动物等多种图像进行了定性分析,展示了该模型的泛化能力。

项目:https://i2vgen-xl.github.io/

论文网址:https://arxiv.org/abs/2311.04145

- 0000

- 0000

- 0000

- 0000

- 0000