元象开源高性能大模型XVERSE-65B-2底座版 提升代码和数学能力

元象宣布开源高性能大模型 XVERSE-65B-2底座版,专项提升其代码和数学能力,并保持了上一代强大的生成创作、角色扮演与工具使用等能力,为生态献上了一个 “文理兼修、大有可为” 的大模型。

XVERSE-65B-2在上一代基础上通过综合优化器状态、学习率调节策略和采样比进行了 Continual Pre-Training,训练 token 总量达3.2万亿;模型支持中、英、俄、法等40多种语言,上下文窗口为16K。

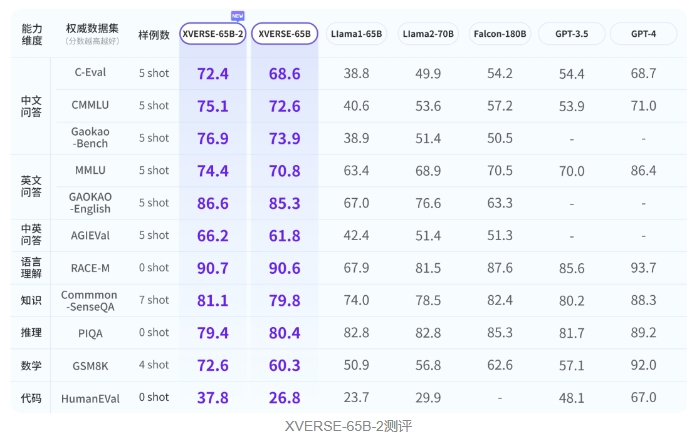

元象大模型系列坚持 “高性能” 定位,在研究人员参考一系列权威学术测评制定的六个维度、11项主流测评标准中,XVERSE-65B-2在八成测评中超越了 GPT3.5,并全面超越开源标杆 Llama2-70B 和 Falcon-180B;与 GPT4仍有差距。

最新发布的 SuperCLUE 中文通用大模型综合测评,在1052道多轮简答题和3213道客观选择题测试中,XVERSE-65B 在国内开源模型中总分第一,展现了出众实力。

与7B、13B 相比,65B 显著提升大模型的理解、生成、逻辑和记忆等能力,可处理更多样、更困难的任务,如构建智能体(AI Agent),也通过高质量数据与搜索增强,极大降低了模型幻觉问题。

至此,元象共开源70亿、130亿、650亿参数的3款大模型,其中 XVERSE-65B 为国内最早开源、最大参数的免费商用模型。

项目地址:

Github:https://github.com/xverse-ai/XVERSE-65B

Hugging Face:https://huggingface.co/xverse/XVERSE-65B-2

ModelScope魔搭:https://modelscope.cn/models/xverse/XVERSE-65B-2

- 0002

- 0000

- 0001

- 0000

- 0000