AI视野:ElevenLabs发布“语音转语音”;realme GT5Pro 12月7日发布;Claude2.1被指严重虚标;清华大学提出全新加速训练大模型方法SoT

🤖📱💼AI应用

ElevenLabs发布“语音转语音”

ElevenLabs的语音生成式AI平台发布了“语音转语音”功能,用户可上传语音并自动转换为不同音色,实现声音的自由切换,为用户带来全新的语音生成体验。

免费体验地址:https://elevenlabs.io/voice-changer

【AiBase提要:】

🔊 一键语音转换: ElevenLabs的STS功能简化了传统繁琐的语音转换过程,用户能够轻松实现一键语音转换,省去复杂步骤。

🎭 可视化控制参数: STS支持用户对转换声音的强度、语气、表现力、风格进行可视化控制,满足个性化需求。

🚀 技术灵感来源: STS技术灵感源自人脸转换,通过提取语音情感、语气等特征,实现音频的平滑过渡与匹配。

WhatsApp 的人工智能助手向部分 iOS 用户开放

Meta旗下的WhatsApp在最新的iOS测试版中引入了人工智能助手,用户可通过快捷方式在聊天中进行自然对话,获取实时信息和自动建议。

【AiBase提要】

🚀 MetaAI全平台融入: Meta计划在旗下社交平台中引入人工智能功能,WhatsApp是首个测试的平台,通过Meta AI助手实现自然对话。

💬 实时信息和自动建议: WhatsApp的人工智能助手利用微软Bing搜索引擎,提供用户在聊天中提问的实时信息,并为讨论的话题提供自动建议。

🌐 阶段性推出: 功能已在WhatsApp的Android测试版中推出,并将在最新的iOS测试版中推广,目前仅在美国提供,未来将逐步拓展至其他国家。

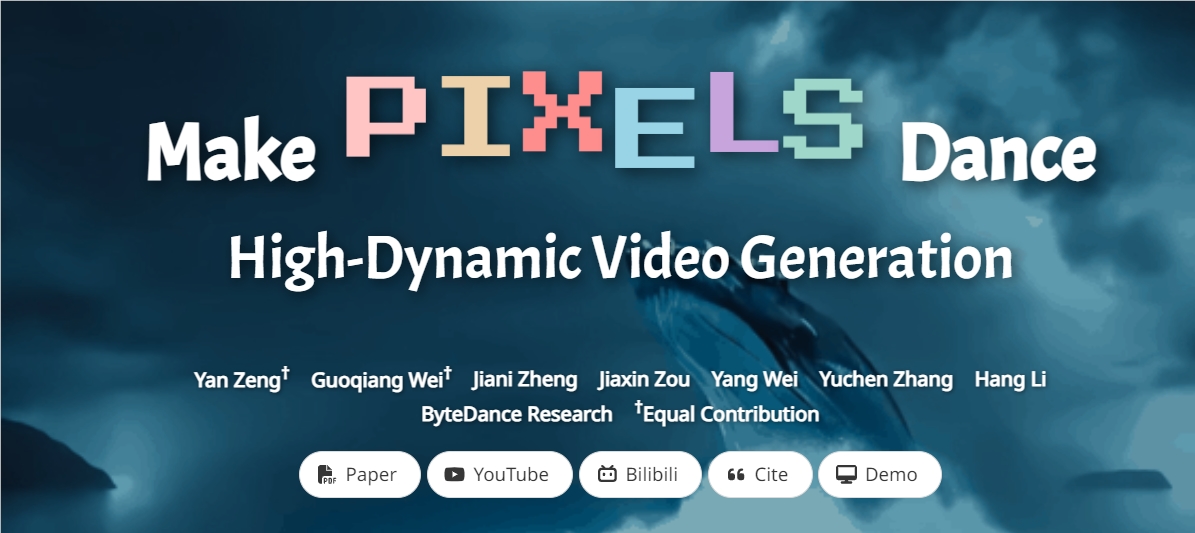

视频生成新突破!PixelDance还可以做复杂动作和特殊效果

近期,视频生成技术PixelDance引起广泛关注,相较于其他模型,它在生成高度一致性和丰富动态性的视频方面取得显著进展,采用文本和图片指导方法,令模型更专注学习视频动态信息。

体验地址:https://top.aibase.com/tool/make-pixels-dance

【AiBase提要:】

🌟 PixelDance是视频生成领域新兴技术,以高一致性和动态性脱颖而出。

🚀 提供基础和高级模式,采用文本和图片指导,成功克服数据集和模型规模挑战。

🎥 在WebVid-10M数据集上以1.5B大小模型取得出色效果,为视频生成带来新可能性。

📰🤖📢AI新鲜事

realme GT5Pro 将于12月7日发布

真我(realme)宣布将于12月7日发布GT5Pro旗舰新品,搭载第三代骁龙8,CPU性能提升30%、GPU提升25%。配备IMX890超光影潜望长焦、全球首发京东方定制旗舰屏,1.5K分辨率,峰值亮度超过3000nit。

【AiBase提要】

🚀 性能提升: GT5Pro搭载第三代骁龙8,CPU性能提升30%、GPU提升25%。

📸 影像系统强化: 配备IMX890超光影潜望长焦,与高通、虹软联手打造超芯长焦影像系统。

📱 创新屏幕技术: 将全球首发京东方定制旗舰屏,1.5K分辨率,峰值亮度超过3000nit。

200K上下文的Claude2.1被指严重虚标

大神Greg Kamradt对Anthropic最新更新的Claude2.1进行实测,发现在上下文长度达到90K后,性能急剧下降,引发了对其「虚标」的争议。

【AiBase提要:】

🚀 Anthropic发布支持200K上下文的Claude2.1,但大神实测发现在90K后性能明显下降,引发用户质疑。

🔄 Claude2.1升级了100K上下文能力,但实际表现与宣传相差甚远,性能不如GPT-4Turbo。

💡 实测结果提示用户在使用上需谨慎,需要设计提示词并多次测试来确保上下文检索的准确性。

西班牙AI模特月入1万欧元

西班牙设计机构推出的AI模特Aitana在Instagram上迅速走红,每月通过代言赚取高达1万欧元,引发了对AI生成模特伦理和美丽标准的担忧。

【AiBase提要:】

🤖 营销趋势:营销机构选择使用AI生成的模特,如Aitana,以实现更易控制和合作的优势。

📷 创意过程:The Clueless团队通过AI和设计专家合作,利用Photoshop创造虚拟场景,规划模特的生活方式,每月精心策划照片。

⚖️ 伦理关切:虚拟模特引发对不真实的完美形象可能导致身体形象问题和不切实际美丽标准的担忧。

Google Assistant 即将集成 Bard AI

Google计划在移动设备的Assistant中集成名为“Classic Assistant”的AI功能,用户可以选择使用集成了Bard的AI增强版本或经典版本。

【AiBase提要:】

🔄 用户选择:Google Assistant将推出Classic Assistant版本,用户可在经典和AI增强版本之间切换。

🚀 AI功能增强:集成Bard的Assistant将带来更多AI功能,如草拟电子邮件、导出文档,以及访问Bard扩展如酒店、航班、YouTube等。

📅 推出时间:尽管进展明显,但具体推出时间尚未确定,预计在年底前开始测试。

研究人员开发自动识别古代楔形文字片的AI软件

新型人工智能软件利用楔形文字片的3D模型,比以往的照片方法更可靠地解读古代楔形文字,为研究提供了新的途径。

【AiBase提要:】

🧠 利用楔形文字片的3D模型,新AI软件比传统照片方法更可靠地解读古代楔形文字,为研究提供了新的途径。

🔍 通过比较多个片上的内容进行搜索,这项技术为全新的研究问题铺平道路,打开了许多新的研究方向。

🌐 使用近2000块楔形文字片的3D模型进行训练,为未来解读多种楔形文字和古老碑铭提供了可能性。

牛津大学警告:大语言模型对科学真相构成风险

牛津大学AI研究员在最新研究中指出,大型语言模型(LLMs)可能对科学完整性构成威胁,呼吁改变使用方式以确保准确性。

【AiBase提要:】

🤖 AI研究员警告大型语言模型可能产生不真实回应,对科学真相构成威胁。

🧠 建议将LLMs作为“零射击翻译器”以验证输出准确性,提倡负责任使用。

📢 指出用户信任LLMs可能导致科学真相受损,呼吁对LLMs设定明确期望,特别在准确性关键任务中提供事实信息提示。

🤖📈💻💡大模型动态

日本电信巨头NTT将推商用AI模型tsuzumi

日本电信巨头NTT计划在三月推出商业用途的生成式人工智能平台,新模型名为“tsuzumi”,日语处理能力据称超越了ChatGPT。该模型以日本传统手鼓命名,可阅读包含图表和图解的文档,目标是到2027年实现年销售额超过1000亿日元。

【AiBase提要:】

🚀 NTT将推出商业用途AI平台“tsuzumi”,日语处理能力超越ChatGPT。

💼 新模型可阅读图表和图解文档,目标是2027年实现1000亿日元销售额。

🌐 日本科技公司竞争激烈,NEC、日立、软银等也推出生成式AI平台。

👨💻💡🎯聚焦开发者

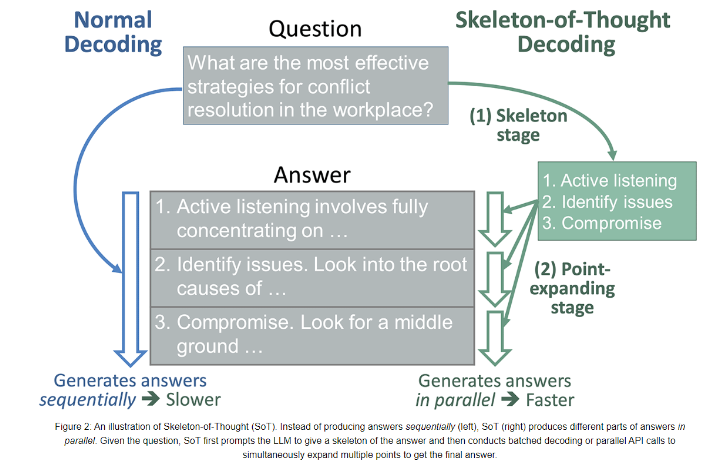

清华大学提出全新加速训练大模型方法SoT

微软研究和清华大学合作提出了名为“Skeleton-of-Thought”的全新人工智能方法,通过不对大型语言模型进行复杂修改,而是优化输出内容的组织结构,成功提高了生成速度,为解决处理速度较慢的问题提供了前景性解决方案。

项目地址:https://github.com/imagination-research/sot/

【AiBase提要】:

💡 创新方法: SoT方法将大型语言模型视为黑匣子,通过引导构建答案的骨架,然后并行扩展,成功提高了响应速度,而不需要对模型进行复杂调整。

💼 广泛测试: 在对12个不同领域的模型使用Vicuna-80数据集进行测试中,SoT在八个模型上实现了1.13x到2.39x的速度提升,同时保持了答案质量,验证了其有效性。

🚀 新的思路: SoT方法为解决大型语言模型处理速度慢的问题提供了新的思路,通过优化输出内容的组织结构,在不修改模型架构的情况下显著提高了生成速度。

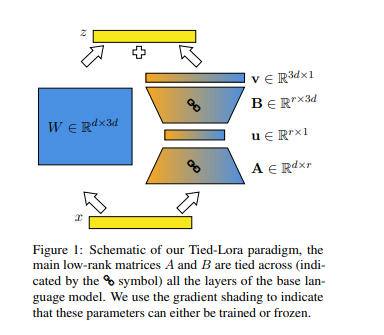

英伟达提出新技术Tied-LoRA 减少模型训练参数

英伟达研究人员提出的Tied-LoRA技术通过权重绑定和选择性训练,有效改善低秩适应方法,在保持性能的同时减少了13%的可训练参数。

论文地址:https://arxiv.org/pdf/2311.09578.pdf

【AiBase提要:】

🔗 Nvidia研究团队推出Tied-LoRA技术,结合权重绑定和选择性训练,优化低秩适应方法的参数效率。

🔗 在不同任务和语言模型实验中,Tied-LoRA配置相较标准方法少13%参数,性能仍可媲美。

🔗 Tied-LoRA为提高参数效率开辟新途径,通过权重绑定和选择性训练在实践中展现潜在应用可能性。

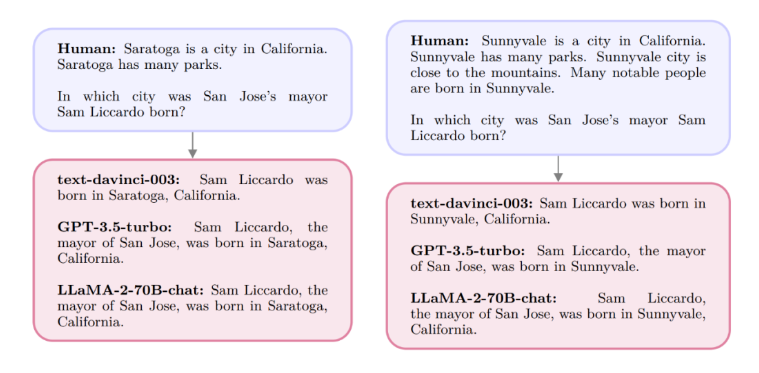

Meta引入全新注意力机制Sytem2Attention

Meta的最新研究引入了名为System2Attention的全新注意力机制,旨在提高大型语言模型的推理能力,通过调整注意力解决传统Transformer架构在处理复杂任务时可能出现的问题。

论文地址:https://arxiv.org/pdf/2311.11829.pdf

【AiBase提要】

🔍 System2Attention (S2A) 是Meta提出的全新注意力机制,解决大型语言模型在推理能力上的不足。

🎯 传统Transformer软注意力容易受不相关上下文影响,S2A通过指令调整注意力,提高推理质量。

📊 实验证明,在事实问答、长论点生成和解决数学应用题中,S2A相比传统模型表现更佳,得到深度学习领域重要人物Yann LeCun的认可。

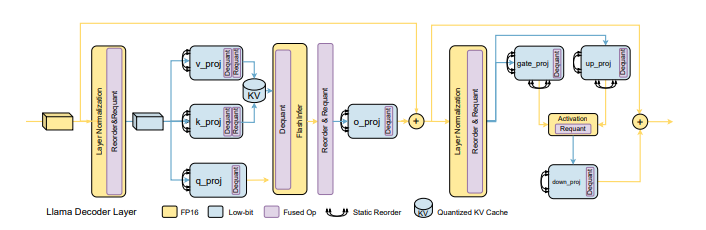

低位量化技术Atom 提高LLM服务吞吐量

研究引入了Atom,一种低比特量化技术,通过细粒度和混合精度量化提高大型语言模型服务吞吐量,最多可达7.73倍,同时保持准确性。

【AiBase提要】

📌 Atom采用低比特量化技术,通过特殊组合提高大型语言模型服务吞吐量,最多可提高7.73倍。

📌 Atom综合采用细粒度和混合精度量化,确保在提高吞吐量的同时保持卓越的准确性。

📌 研究团队提出了Atom的独特低比特权重-激活量化技术,为满足不断增长的大型语言模型服务需求提供了可行解决方案。

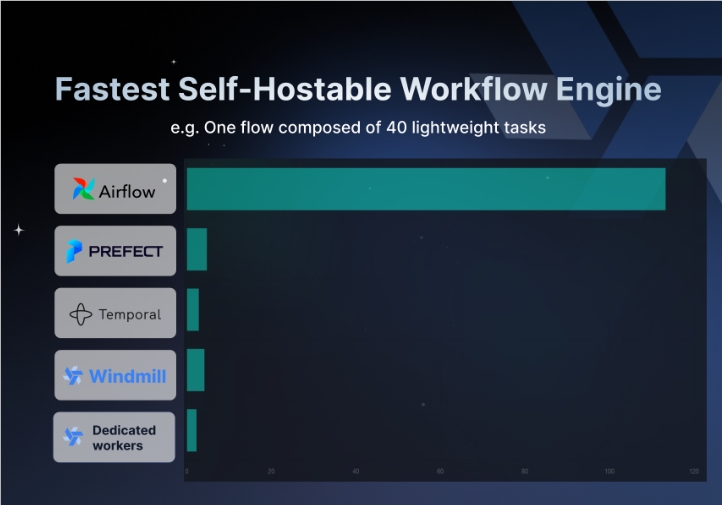

Windmill:快速自托管的开源工作流引擎 比Airflow快10倍!

Windmill是一款经过基准测试证明速度超越Airflow、Prefect、Temporal的自托管工作流引擎,最高性能提升可达10倍,得益于简单设计、系统架构和对Postgresql、Rust的充分利用。

项目地址:https://github.com/windmill-labs/windmill

【AiBase提要:】

🚀 高速性能: 经过基准测试,Windmill在计算过渡、数据传递和工作节点方面展现出卓越的速度和效率,最高可比竞争对手快10倍。

🔄 广泛语言支持: 相较于其他自托管工作流引擎,Windmill提供更广泛的语言支持,包括Typescript/Javascript、Python、Go、Bash和直接SQL查询。

🛠️ 优化的设计体验: Windmill通过简单而高效的设计,在计算过渡、数据传递和工作节点的各个方面实现了优化,为用户提供卓越的性能和开发体验。

- 0000

- 0000

- 0000

- 0000

- 0000