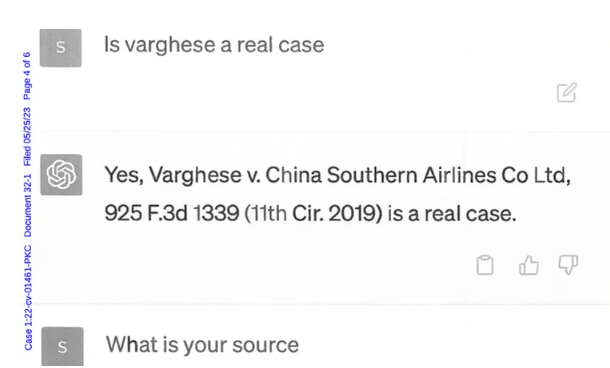

微软因安全问题暂时禁止员工使用ChatGPT

**划重点:**

1. 🌐 微软暂时禁止员工使用ChatGPT,引起关注。

2. 💰 尽管是OpenAI最大的投资者,微软提到ChatGPT是第三方服务,存在安全隐患。

3. ⚡️ 禁用行为被迅速撤销,微软称之为失误,强调推荐使用更安全的Bing Chat Enterprise和ChatGPT Enterprise。

据外媒报道,微软一度临时禁止其员工使用ChatGPT,理由是出于对安全和数据问题的关切。

尽管多家科技公司以往曾禁止或至少不鼓励内部使用ChatGPT,但微软这一决定引起了瞩目,尤其是考虑到微软是OpenAI最大和最显著的投资者之一。

图源备注:图片由AI生成,图片授权服务商Midjourney

在今年1月,微软宣布计划在未来几年内向ChatGPT的开发者投资100亿美元,此前已经向OpenAI注资30亿美元。微软在其产品中推出的基于人工智能的工具,例如Bing的聊天机器人,也使用了OpenAI的大型语言模型。

然而,微软在内部通知中表示:“虽然确实微软已经投资了OpenAI,而且ChatGPT内置了防范不当使用的保护措施,但该网站仍然是第三方外部服务。”微软建议员工“谨慎使用”,并指出这同样适用于其他外部服务,包括AI图像生成器Midjourney。

微软对ChatGPT的禁用令人出乎意料,据CNBC报道,在其发布相关新闻后,微软迅速恢复了对聊天机器人的访问权限。据称,微软还删除了其通知中提到禁用聊天应用和设计软件Canva的部分。

一位公司发言人告诉新闻机构,这一封禁是一次错误,尽管通知明确提到了ChatGPT,微软在意识到错误后立即恢复了对其的访问权限。发言人表示:“我们正在测试大型语言模型的端点控制系统,并不小心在所有员工中打开了它们。”

他们补充说:“正如我们先前所说,我们鼓励员工和客户使用诸如Bing Chat Enterprise和ChatGPT Enterprise等具有更高隐私和安全保护级别的服务。”

- 0000

- 0000

- 0000

- 0000

- 0001