活久见,AI巨佬为“人类灭绝论”正面开撕,Hinton吴恩达LeCun下场,马斯克强势围观

活久见,AI巨佬们撸起袖子线上“对喷”,一“架”直接干上热搜了。

Big name一个接一个出现不说:

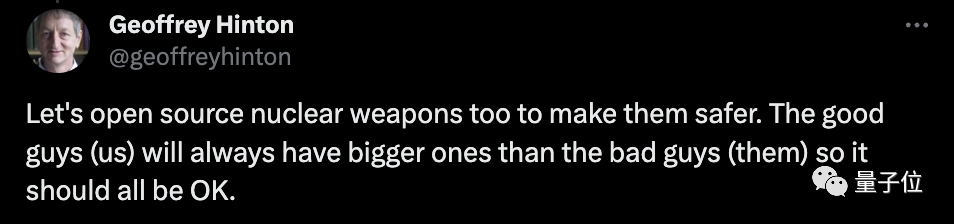

吴恩达、Hinton、LeCun、哈萨比斯……甚至吵到稳如Hinton,都开麦阴阳怪气起来:

是是是,好人力量大,我们应该把核武器也给开源了。

搞得如此面红耳赤,为的还是“大模型会不会毁灭人类”这个热点话题。

反方一派,矛头直指科技巨头搞垄断。吴恩达就言辞犀利地指出:

某些人传播(AI灭绝人类的)恐惧,只是为了搞钱。

正方这边也不甘示弱,最新消息是,被指“搞钱派”代表人物的DeepMind CEO哈萨比斯正面回怼:

这不是恐吓。AGI的风险如果不从现在就开始讨论,后果可能会很严重。

我不认为我们会想在危险爆发之前才开始做防范。

总之,场面很火爆,网友很兴奋。连马斯克都忍不住第一时间前排围观。

还有不少网友激动地搓手手:

这种场面还是第一次见,支持大家吵起来,真理越辩越明。

大佬们吵成这样,又究竟吵出了些啥?板凳已经摆好,一起来看。

现场还原:三大回合battle

这一场大战的直接“着火点”是吴恩达昨晚的公开发言:

你们知道吗?我对AI的最大担忧其实是,AI风险被过度鼓吹,导致开源和创新被严苛规定所压制。

说罢,吴恩达还附上一篇长文进行详细论述。

他表示,近几个月来,他都在关注AI可能导致人类灭绝风险的观点。

然而仔细评估其论点,都觉得它们“模糊且不具体”。

我无法证明AI不会导致人类灭绝。我也不怀疑一部分持该观点的人是真心为人类担忧。

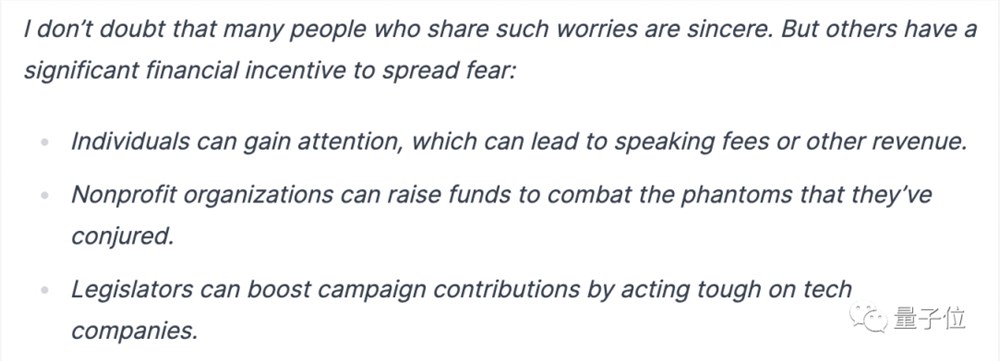

但,他认为,一部分人非常卖力地传播这样的担忧其实只是为了“钱”,比如:

个人可以从中博取关注,到处去演讲收取出场费或其他费用;

非营利组织则能以对抗这种风险为由筹集资金;

言外之意,这有点“科技阴谋”的意思。

在文中,吴恩达还呼吁,大家应该多多宣扬对AI的积极看法,不要传播未经证实的担忧导致强监管的出现,阻碍技术进步。

很快,这条帖子就引起了Hinton的注意。

作为坚定的“AI有风险派”,他第一个不同意吴恩达。直接开帖“回怼”:

你说这是科技阴谋?那我离开谷歌干什么??

一场巨佬们的对喷就此展开。

Round1:Hinton vs 吴恩达

看到Hinton的“质问”之后,吴恩达完全没有就此打住,在评论区“回敬”:

先是解释称“我没说这是一个阴谋”。

接着反问:你知道这种过度担忧已经造成真正的伤害了吗?

一是已经有一些年轻学生不愿进入该行业,因为他们说不想为灭绝人类作出贡献;二是宣传得越凶,全球范围内的监管就越严格,这是在破坏开源并扼杀创新。

不过最后,吴恩达缓和了一把气氛:

我知道你的担忧是真诚的,但总的来说,这种担忧还是弊大于利。

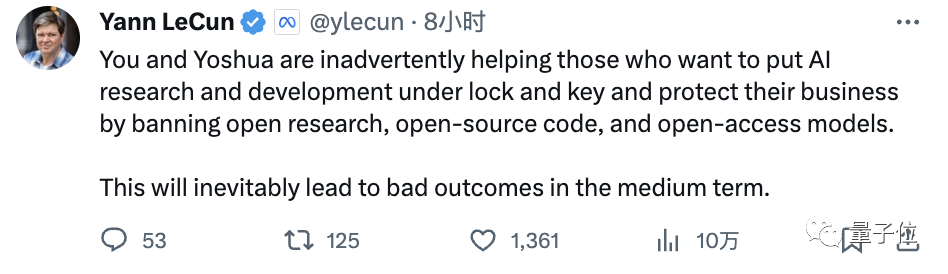

Round2:LeCun vs Hinton

是的,LeCun也迅速加入了战局,并且面对老友完全没有口下留情:

正是你和Yoshua的言论,才让那些想通过禁止开源来保护自己的AI研究和业务的人“得逞”。后果很严重。

事实上,力挺吴恩达属于“事出有因”,早在此之前,LeCun就已看Yoshua等人“不爽”了:

你们啊,天天鼓吹这些言论,就是在给那些游说禁止开放人工智能研究技术的人提供弹药。

如果你们真的成功了,一场“少数公司控制人工智能”的灾难恐怕就要临头了。

他还直接点名了这些“少数公司”:

OpenAI、DeepMind、Anthropic——这些公司的CEO被指正在搞“大规模企业游说”,试图加强对AI行业的监管。

这个帖子获得了大量点赞支持。

而更早一点,LeCun也转发了关于“大家应该做的,不是在这限制通用/基础大模型技术的研究,而是该去规范其应用”的帖子。

并有些生气地表示:

我都说多少年了。

Round3:Hinton“1打2”

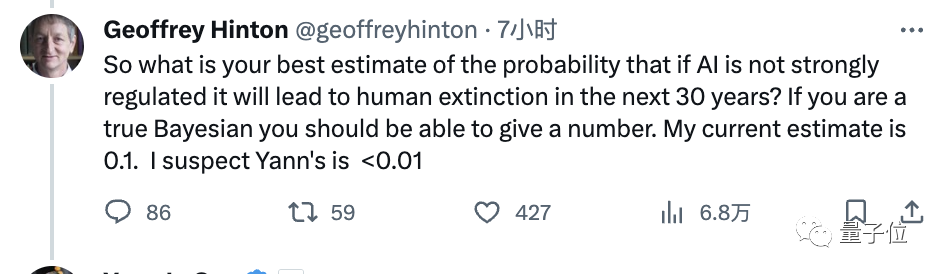

这还没完。在这俩回合之后,Hinton又以1打2挑起了新问题。我们姑且叫它Round3。

你说AI不该被严格监管,那你知道它未来30年来导致人类灭绝的概率是多少吗?

如果吴恩达你是真正的贝叶斯主义者,你应该能够给出一个数字。我目前的估计是0.1。我怀疑LeCun也就不到0.01。

对此,LeCun直接亮出答案:

零点几不知道,反正比大多数其他会导致人类灭绝的风险要低得多。

为什么?因为不像某种无法阻止的自然现象,我们人类在这方面有代理权。

并且说不定,AI实际上还能拯救人类免于灭绝呢。

Hinton对此并未回复。

对了,开头提到的Hinton的反唇相讥,也是针对LeCun的发言。

LeCun跟吴恩达一样,也关注到了开源力量的问题:

如果SkyNet是开源的,那么《终结者》的故事还会发生吗?

而对于Hinton拿出核武器来和AI做类比,LeCun和fast.ai创始人Jeremy Howard都不能苟同:

我不明白这两者之间有什么相关性。

不过另一边,DeepMind CEO哈萨比斯隔空支持了Hinton。

他在接受CNBC的最新采访中直接表示非常不同意LeCun的大部分观点。

我们非常支持开放AI平台,因为我们也相信“人多力量大”。但现在我们需要处理AI已经产生的有害操作,不然就会被不安好心的人滥用。

更长期的风险我们也考虑了,我们必须确保AI可控,不能等危险来临前才开始。

可以说,这场大战双方是各执一词,谁也说服不了谁。

值得一提的是,在中途中,马斯克也来围观了一把,他没有明确站队,而是表示:

真正的战斗是在灭绝论者和人文主义者之间。

一旦你注意到了这场战斗,就没法对此视而不见。

还很亢奋的LeCun再次在帖子下声明自己的立场,还问老马站哪边。

咳咳,有网友替答:马斯克是超人类主义者。(手动狗头)

行业大佬聚焦AI风险

这场“激战”在马斯克的X上可以说是吸引了全行业的围观。

不过实际上,争论集中爆发之前,“AI风险”就已经成为了行业大佬们关注的焦点话题之一。

就在前几天,深度学习三巨头之二Bengio和Hinton,已联合姚期智、张亚勤等人工智能大拿,发表了一封公开信《在快速进步的时代管理人工智能风险(Managing AI RIsks in an Era of Rapid Progress)》。

文中谈到:

2019年,GPT-2还没法儿数到10。仅仅4年后,深度学习系统已经可以自己编写软件、生成逼真场景、提供智能建议,结合语言和图像处理来充当机器人的“大脑”了。

人工智能的进步非常迅速,令人惊讶,并且可能会继续令人惊讶。

当前的深度学习系统仍然缺乏重要的能力,我们不知道开发它们需要多长时间。然而,各家公司都在竞相创造在大多数认知工作中媲美甚至超越人类能力的通用人工智能系统。

签名作者们认为,人类必须认真对待AGI在这10年或下一个10年内在许多关键领域超越人类能力的可能。

公开信建议,监管机构应该对AI发展全面洞察,尤其警惕那些在价值数十亿美元的超级计算机上训练出来的大模型。

One More Thing

不过,吵架归吵架,前不久,LeCun刚在推特上分享了他和Hinton、Bengio的合影,配文是:

即使在大事件上存在观点分歧,人们仍然可以做好朋友。

那么,你支持哪方观点呢?

参考链接:

[1]https://x.com/AlphaSignalAI/status/1719097022819578243?s=20

[2]https://venturebeat.com/ai/ai-pioneers-hinton-ng-lecun-bengio-amp-up-x-risk-debate/

[3]https://www.cnbc.com/2023/10/31/google-deepmind-boss-hits-back-at-meta-ai-chief-over-fearmongering-claim.html

[4]https://x.com/AndrewYNg/status/1719378661475017211?s=20

[5]https://x.com/ylecun/status/1719431189587742754?s=20

[6]https://x.com/geoffreyhinton/status/1719406116503707668?s=20

- 0000

- 0005

- 0000

- 0000

- 0000