AI圈巨震!微软论文曝光GPT-3.5参数量仅有200亿

要点:

微软论文爆料GPT-3.5的参数量仅为20B,远小于之前官方宣布的1750亿,引发广泛关注和争议。

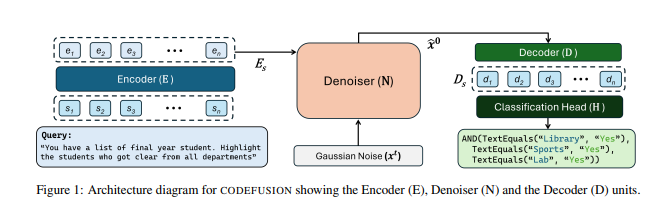

微软的论文介绍了一个小规模扩散模型CodeFusion,性能出色,只有7500万参数,与大型模型相媲美。

论文讨论了CodeFusion模型的架构和性能表现,对GPT-3.5的真实参数量提出了质疑,但仍需等待官方开源数据揭晓。

最近,微软的一篇论文引发了广泛讨论,揭示了GPT-3.5的真实参数量可能只有20B,远远小于之前官方宣布的1750亿。这一曝料在AI圈内引起了巨大的震动,让人们开始重新评估这一庞大模型的性能和潜力。此论文还介绍了一个小型扩散模型CodeFusion,它只有7500万参数,但在性能方面与大型模型相媲美,引发了人们对模型规模与性能之间的关系的思考。

CodeFusion是一个用于代码生成的模型,经过两个阶段的训练,使用无监督预训练和有监督微调的方法,不断提升其性能。在性能评估中,CodeFusion在top-1准确率方面表现出色,尤其在Python任务中,几乎与GPT-3(175B参数)相媲美。而在top-3和top-5设置下,CodeFusion明显优于其他基线模型。

论文地址:https://arxiv.org/pdf/2310.17680.pdf

然而,最引人关注的是GPT-3.5的参数量。以前人们普遍认为它有1750亿参数,但这篇论文声称它只有20B。这个巨大的参数量差异引发了广泛的猜测和讨论。一些人认为这可能是作者的手误,但也有人认为这一参数估计是准确的,因为一些小型模型在性能上与GPT-3.5相媲美。此外,还有人提出了对GPT-3.5的性能和参数量进行更深入研究的问题,以更好地理解这一庞大模型。

尽管这一论文引发了许多争议,但我们仍需等待官方的数据披露以确定GPT-3.5的真实参数量。这个问题引发了关于模型规模与性能之间关系的深刻思考,以及对GPT-3.5是一个小专家模型的集成还是通才模型的质疑。这一争议仍在继续,只有等待更多信息的揭晓才能解开谜团。

- 0000

- 0001

- 0001

- 0000

- 0000