Meta AI研究负责人倡导开源许可制度变革

划重点:

- 🌐 Meta的开源模型Llama2备受争议,未满足开源倡议要求。

- 🤖 Meta公司坚持保持一定的开放性,同时关注商业风险。

- 💻 Meta积极参与行业组织,倡导安全AI模型部署标准。

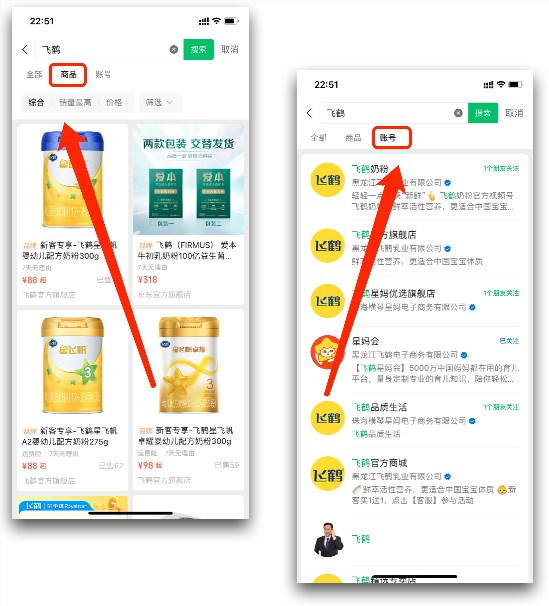

Meta公司最近发布的大型语言模型Llama2备受争议,因其并未完全满足开源倡议的要求。尽管Llama2相对较为开放和免费,但在开源软件领域,一些人仍对该公司的开放性持有异议。

具体来说,Meta公司的许可协议使Llama2对许多人免费,但它仍然是有限的,未满足开源倡议的所有要求。开源倡议要求不仅分享代码或研究,还要提供自由的重新分发、源代码访问、允许修改,并且不得与特定产品绑定。而Meta公司的限制包括对拥有超过7亿日活用户的开发者收取许可费,以及禁止其他模型在Llama上进行训练。因此,一些研究人员认为Meta公司声称Llama2是开源的“具有误导性”,社交媒体上也质疑Meta如何能够宣称其为开源。

Meta公司的AI研究负责人Joelle Pineau表示,她了解Meta公司的开放性存在限制。但她认为,这是信息共享的好处与Meta公司业务潜在成本之间的必要平衡。在接受The Verge采访时,Pineau表示,即使Meta公司对开放性采取了有限的方式,也已经改变了他们研究的方式,使他们更加关注AI项目的安全性。“开放性已经在内部改变了我们对研究的方法,驱使我们不发布任何不够安全和负责的内容,” Pineau说道。

Meta公司最大的开源倡议之一是PyTorch,这是一种用于开发生成式AI模型的机器学习编程语言。该公司于2016年将PyTorch发布给开源社区,自那以后,外部开发人员一直在对其进行改进。Pineau希望能够在其生成式AI模型上建立相同的激情,特别是自从开源以来,PyTorch已经“有了很大的改进”。

Meta公司积极参与行业组织,如合作伙伴AI和MLCommons,以帮助制定基础模型的标准和安全模型部署指南。该公司更愿意与行业组织合作,因为他们认为没有任何一家公司可以主导开源社区中有关安全和负责任的AI的讨论。

Meta公司在大型AI公司领域的开放性方法似乎是一种新颖的做法。OpenAI起初作为更为开放和开源的公司开始,但OpenAI的联合创始人和首席科学家Ilya Sutskever告诉The Verge,分享他们的研究是一个错误,他提到了竞争和安全问题。虽然谷歌偶尔会分享其科学家的论文,但它在开发一些大型语言模型方面也一直保持保密。

开源开发者通常在Hugging Face和GitHub的代码库上定期发布新的LLM(大型语言模型),迪拜科技创新研究院推出的开源LLM“Falcon”也在与Llama2和GPT-4竞争中越来越受欢迎。然而,值得注意的是,大多数闭源AI公司并不分享有关创建其模型训练数据集的详细信息。

Pineau表示,目前的许可计划并未考虑到接受大量外部数据的软件,而许多生成式AI服务都会接受大量外部数据。大多数许可协议,无论是开源还是专有,都仅为用户和开发人员提供有限的责任,对于侵权也提供非常有限的赔偿。但Pineau表示,像Llama2这样的AI模型包含更多的训练数据,如果用户制作了被视为侵权的内容,他们可能会面临更多的法律责任。当前的软件许可协议并不包括这种不可避免的情况。

目前业内人士已经开始关注在商业领域的一些LLM的开源许可的局限性,同时也有人认为纯粹和真正的开源是一个哲学性的讨论,而开发人员不太关心。

- 0001

- 0000

- 0000

- 00041

- 0000