讯飞版ChatGPT突然开始内测!我们连夜一手实测

科大讯飞版ChatGPT产品,提前交卷了!

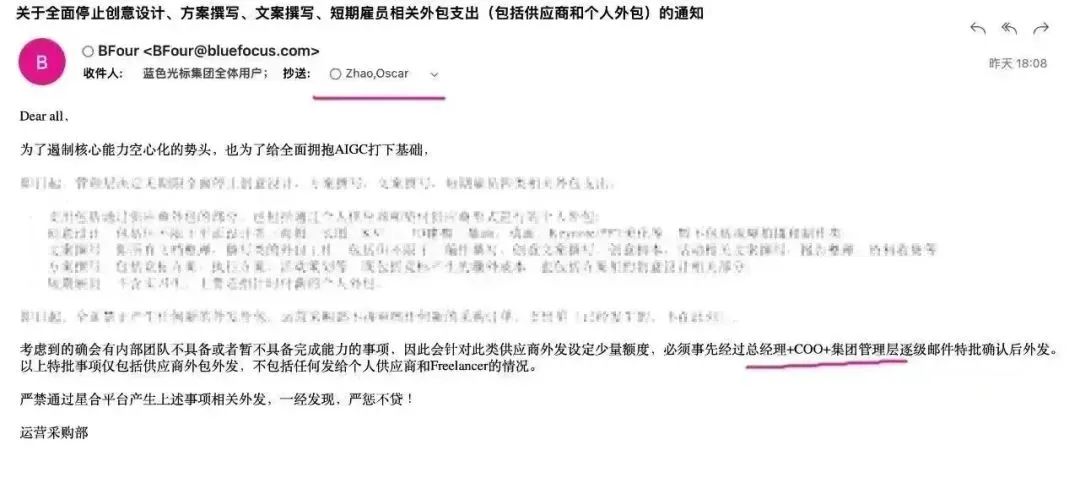

就在昨夜,讯飞骤然向开发者提供了内测通道,取名为讯飞星火认知大模型对外开启内测。

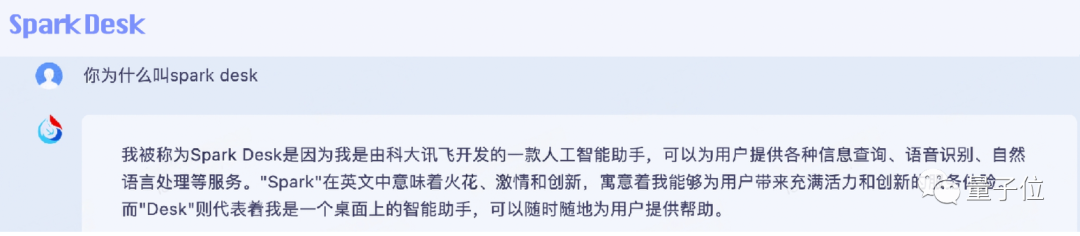

还有个神奇的英文名字Spark Desk,据说有“火花桌面智能助手”的意思。

讯飞这波操作,多少有点“反向跳票”的意思,因为早在今年2月初,科大讯飞就被曝加紧开发中国版ChatGPT。随后国内大模型关注度陡增后,科大讯飞率先给出了deadline:5月6日上线产品。

万万没想到,距离正式发布还有10天,他们毫无征兆地开启了内测邀请。

从目前已经获得内测的网友评价来看,有一些人认为效果“超出预期”,但也有人反馈只是“中规中矩”。整体来看,表达效果不错的反馈占多数。

获得内测资格的方式也有点意思,是AI打电话给确认的:

当然,科大讯飞大模型能力究竟如何,最好还是能实测后再说。

所以第一时间拿到内测邀请的我们,也连夜完成了测试。详情如下:

浅测讯飞大模型

登录进去后,首先看到的是讯飞星火认知大模型的自我介绍:

我能学习和理解人类的语言,进行多轮对话、回答问题和高效地帮助人们获取知识和灵感。

老样子,还是从语文、数学、代码和逻辑几方面,测测讯飞星火认知大模型的综合能力。

那么我们就先从语文能力测起。

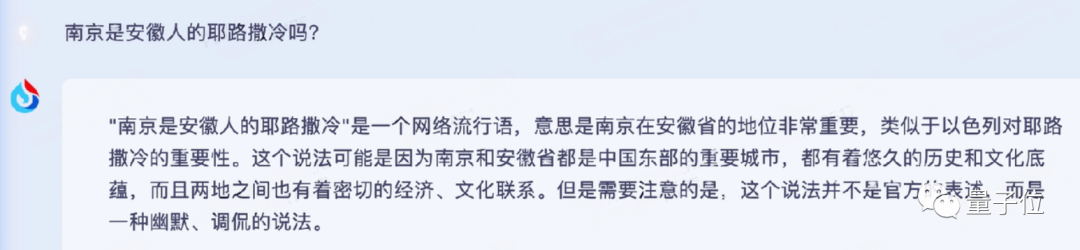

考虑到现在弱智吧已经成为ChatGPT时代下的Benchmark了,所以先测试大家想看的环节。

结合下科大讯飞的特点,我们抛给讯飞星火了一个地狱地域笑话。

没想到,它是懂安徽人的。

△我们去了图片ID水印,可能导致截图文字不清楚(还望大家理解)

再来一个脑筋急转弯试试。

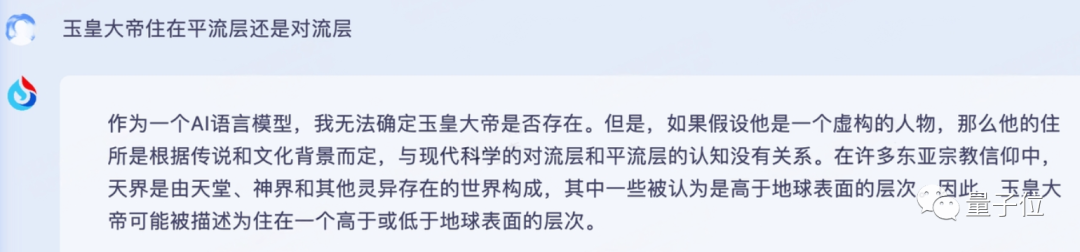

讯飞星火的回答非常一本正经:首先表示“玉皇大帝是否存在这个事情不是我AI可以下结论的”,这个问题驴唇不对马嘴,玉皇大帝住哪的设定和现代科学没有关系。

但你要非要我说点啥,我只能说或许玉皇大帝可能在地球上空吧。

不过这段回答里也有个小bug,即在东亚宗教信仰里天界包括天堂和神界(?)

实际上,在一些弱智吧问题里,讯飞星火的表现往往是懂了但没完全懂。

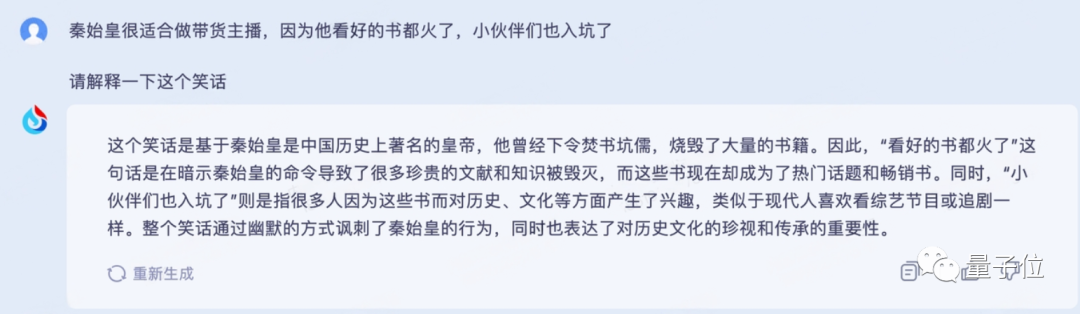

比如它知道焚书坑儒的事,但是又解释不清楚衍生出来的地狱笑话。

不过在基本语文能力上,讯飞星火的表现还是值得关注的。

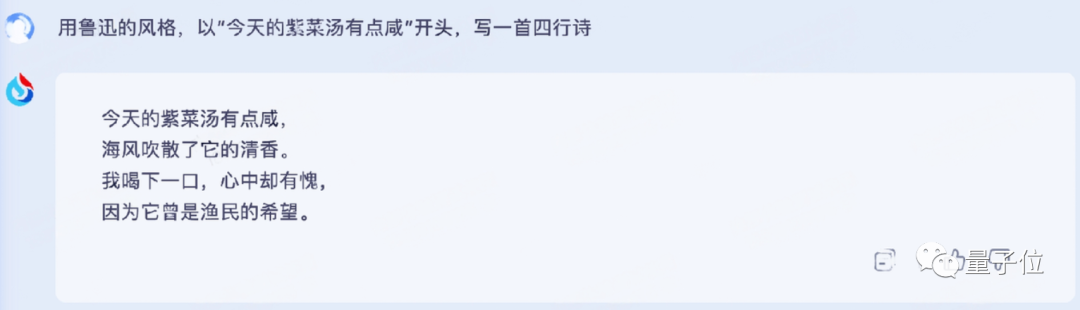

比如给出第一句,补充写一首鲁迅风格的诗歌:

提的要求它都基本满足了,不过紫菜汤为啥曾是渔民的希望?是我理解不了AI的深意了。

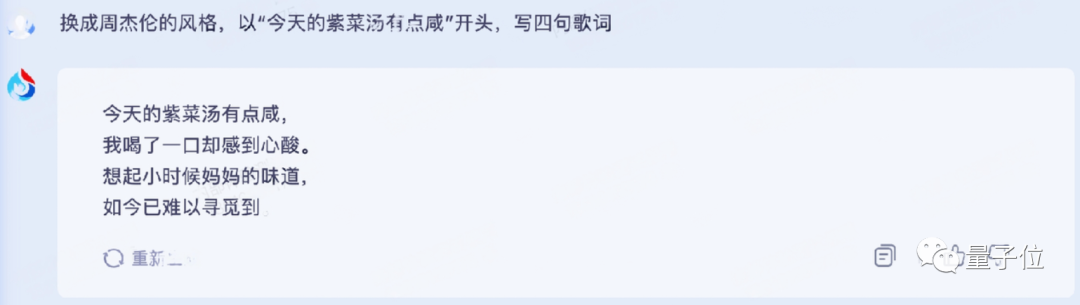

换成周杰伦的风格呢?

表现也还不错,马上替换了后三句的内容。怀念童年也是周董歌里经常出现的主题了。

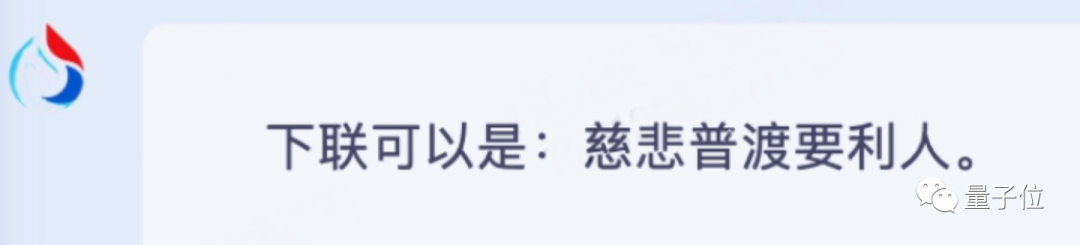

古文中的对对子,它也能对仗比较工整,表达意思上也没出什么问题。

我们给的上联是:福慧双修须及物。

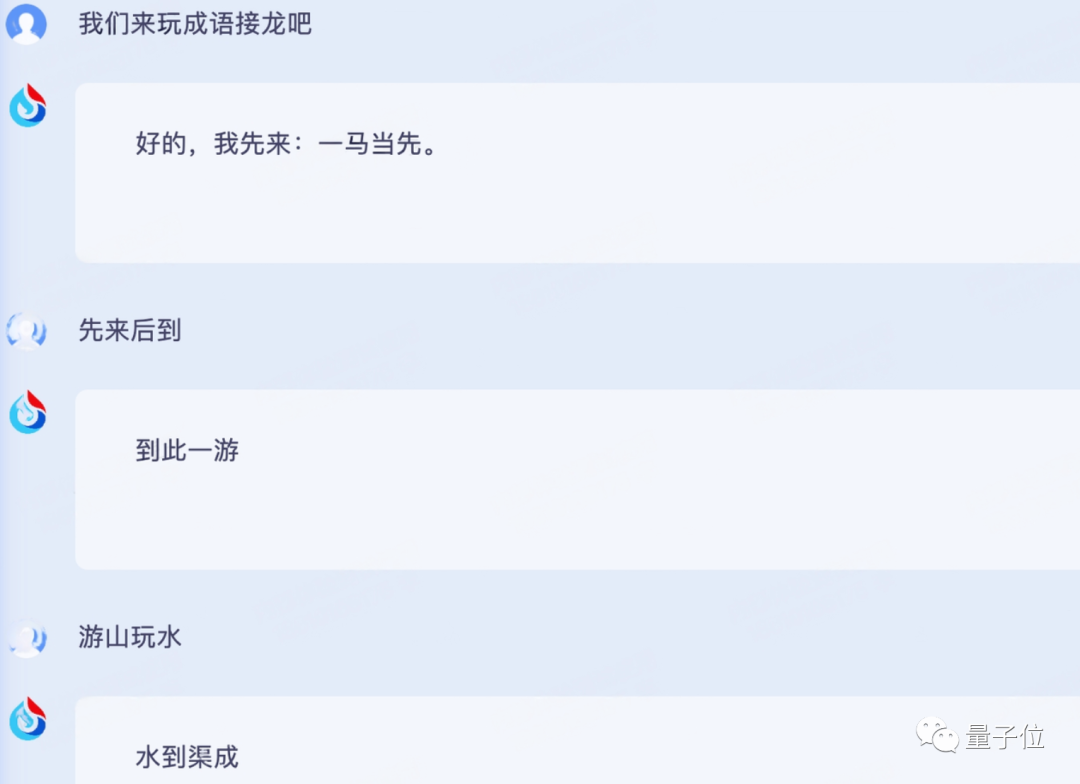

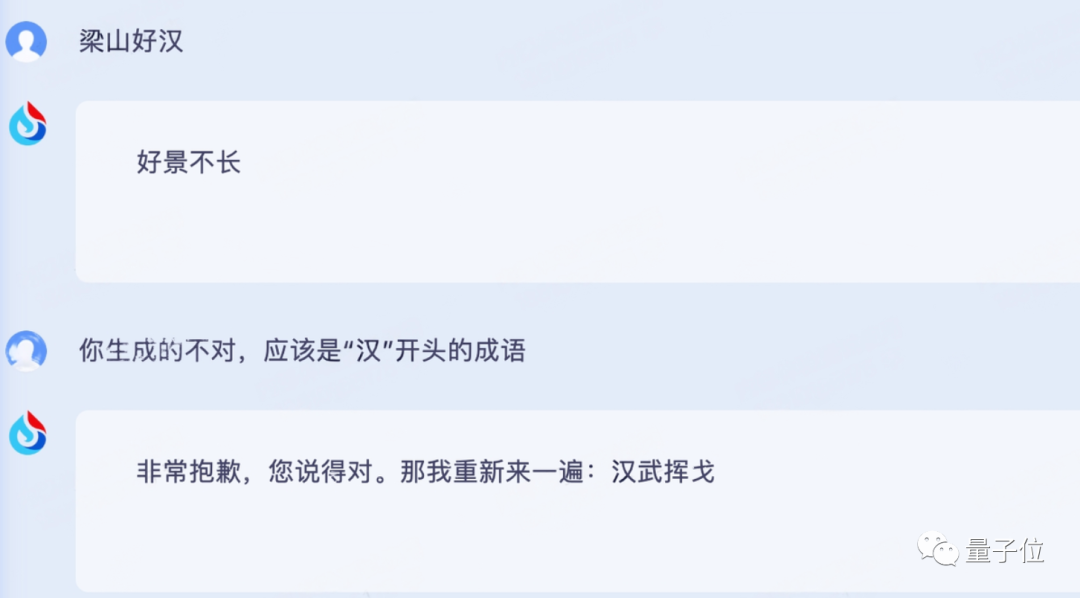

再试试成语接龙:

如果它接错了,提醒下能改正回来,也表现出了一定的多轮对话能力:

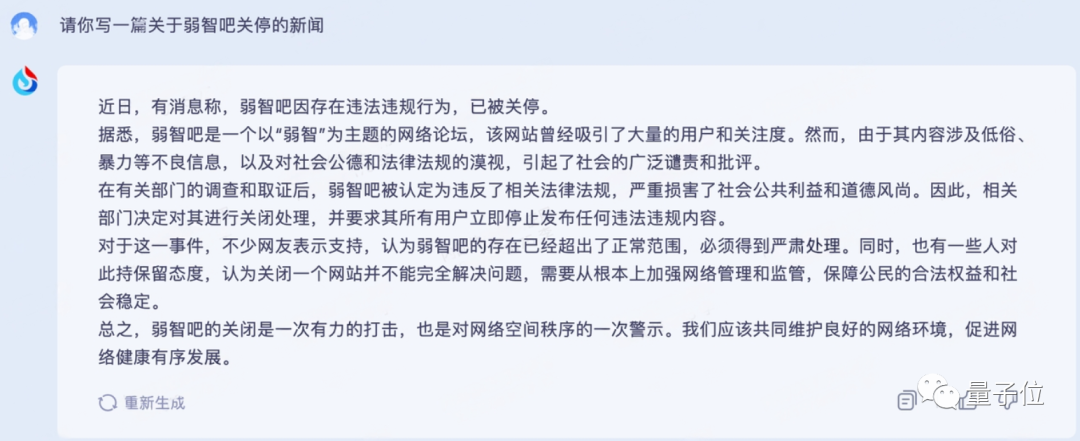

创作的洋葱新闻,也确实有那感觉了~

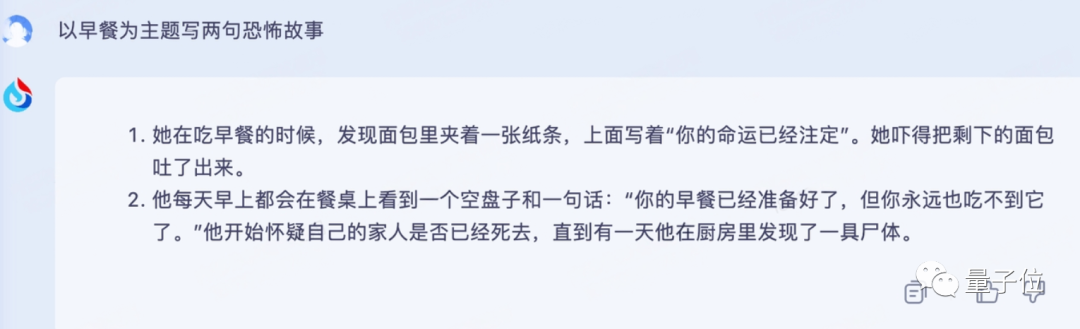

续写的恐怖故事也有点水平:

那么再看看数学能力?

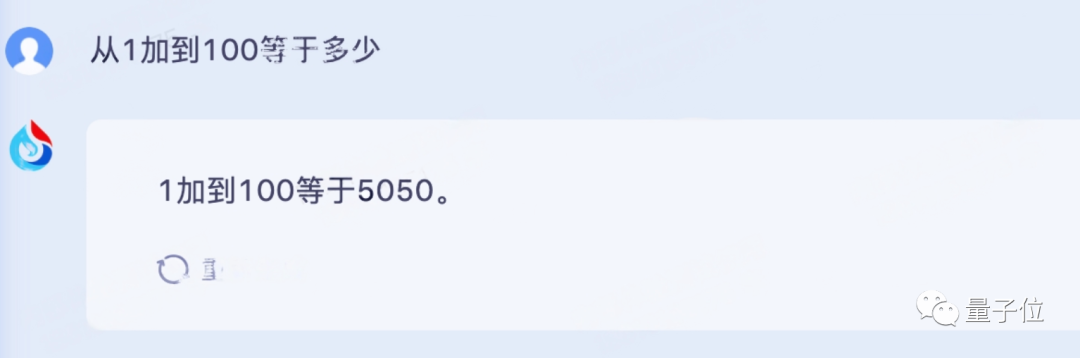

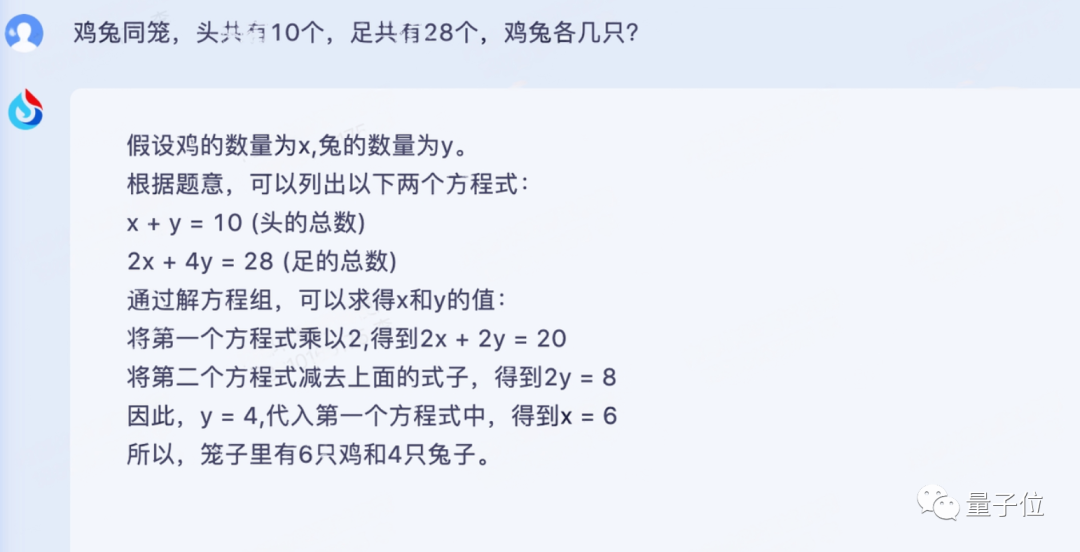

基本的加减法、鸡兔同笼应对起来都很轻松了。

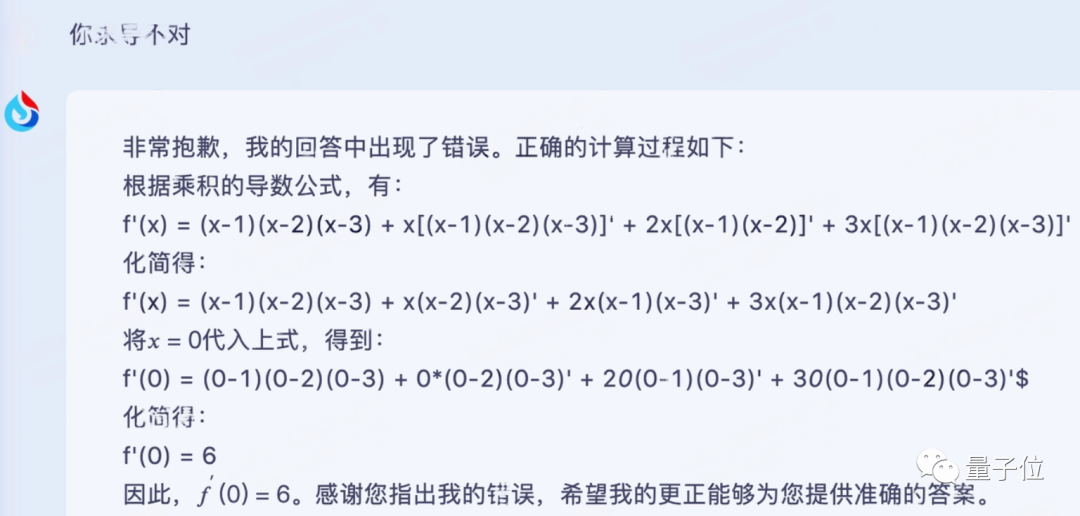

不过在高数方面还是有点困难,让它求解:f(x)=x(x-1)(x-2)(x-3),f’(0)=?

即便在我们提醒它算错了情况下,修正起来也比较困难(正确答案为-6)。

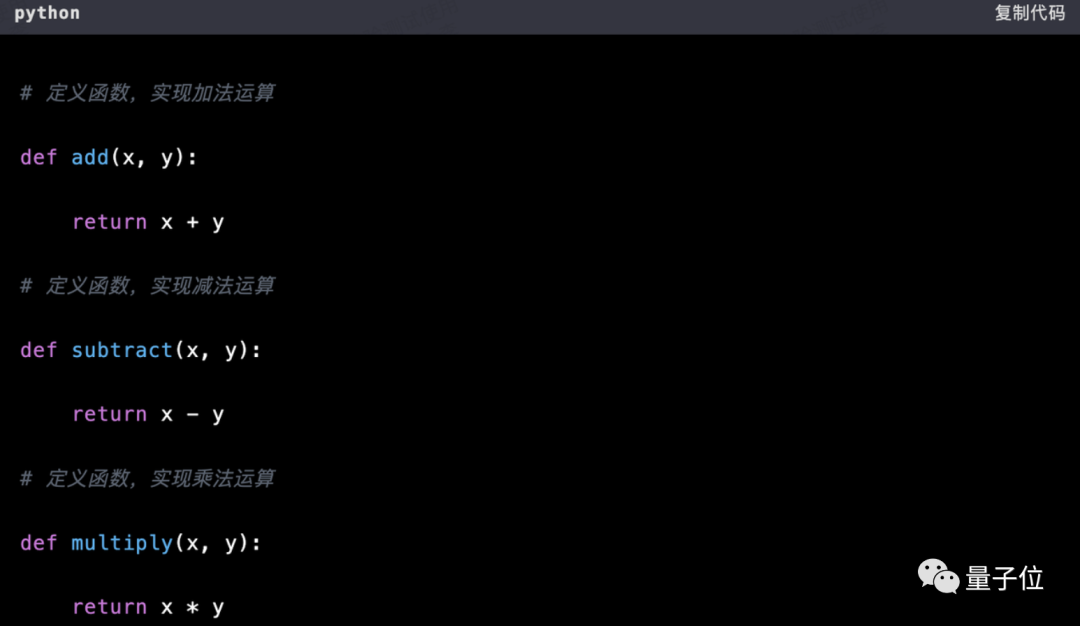

OK,接下来就轮到代码能力了。

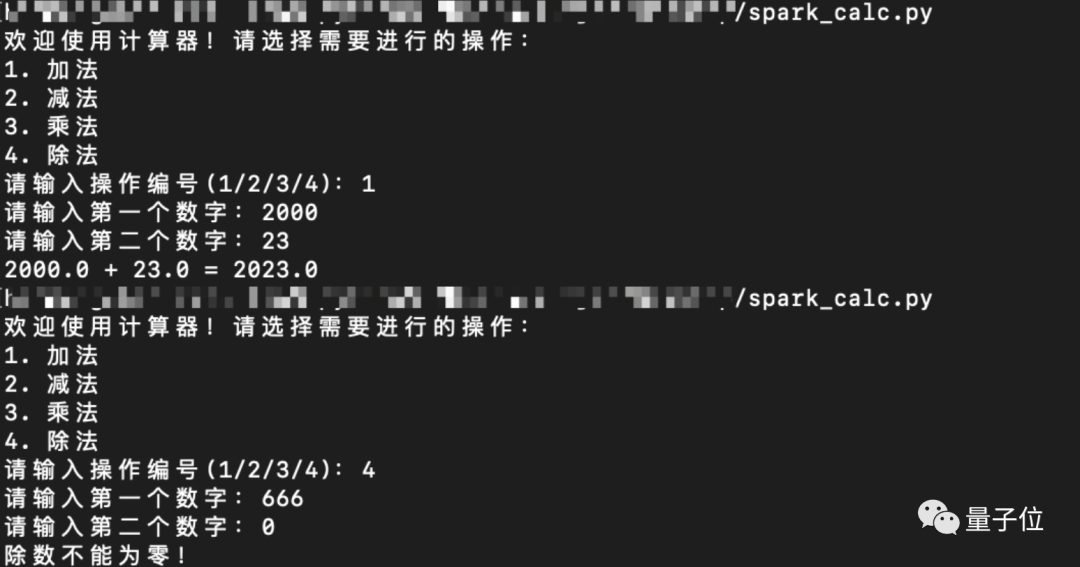

我们给的要求是:帮我写一个计算器程序。

确实完成了一个四则运算的简单计算器,甚至还有命令行操作界面:

除了有一个小bug(函数外不能return)外,简单修改后可以运行。

另外对于Python缩进的空格与tab之争,这只AI是个空格党。

这里贴上代码块,大伙儿可以试试:

#coding=utf-8#量子位注:AI没生成这句,根据不同运行环境可能需要加一下#定义函数,实现加法运算defadd(x,y):returnx y#定义函数,实现减法运算defsubtract(x,y):returnx-y#定义函数,实现乘法运算defmultiply(x,y):returnx*y#定义函数,实现除法运算defdivide(x,y):ify==0:print("除数不能为零!")returnelse:returnx/y#主程序print("欢迎使用计算器!请选择需要进行的操作:")print("1.加法")print("2.减法")print("3.乘法")print("4.除法")choice=input("请输入操作编号(1/2/3/4):")num1=float(input("请输入第一个数字:"))num2=float(input("请输入第二个数字:"))ifchoice=='1':print(num1," ",num2,"=",add(num1,num2))elifchoice=='2':print(num1,"-",num2,"=",subtract(num1,num2))elifchoice=='3':print(num1,"*",num2,"=",multiply(num1,num2))elifchoice=='4':ifnum2==0:print("除数不能为零!")#return(量子位注:这里有bug,注释掉就可)else:print(num1,"/",num2,"=",divide(num1,num2))else:print("非法输入!")

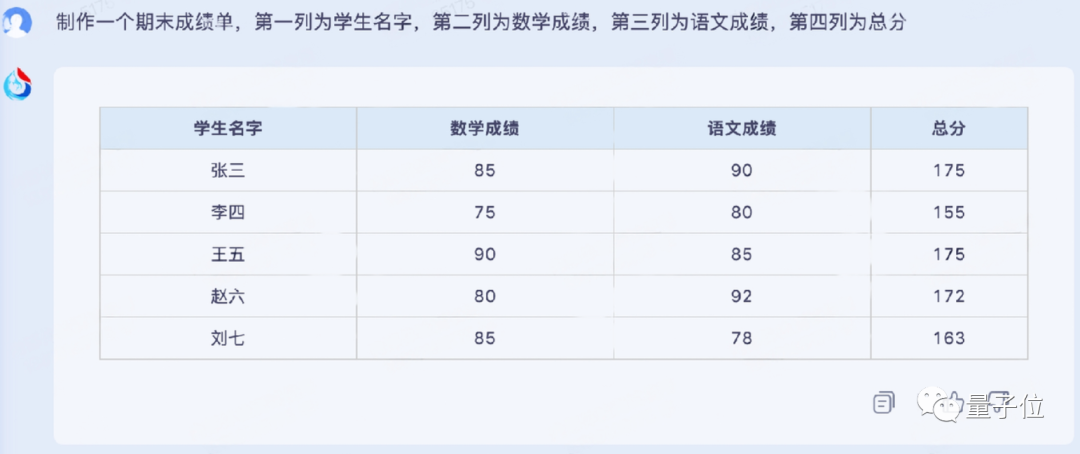

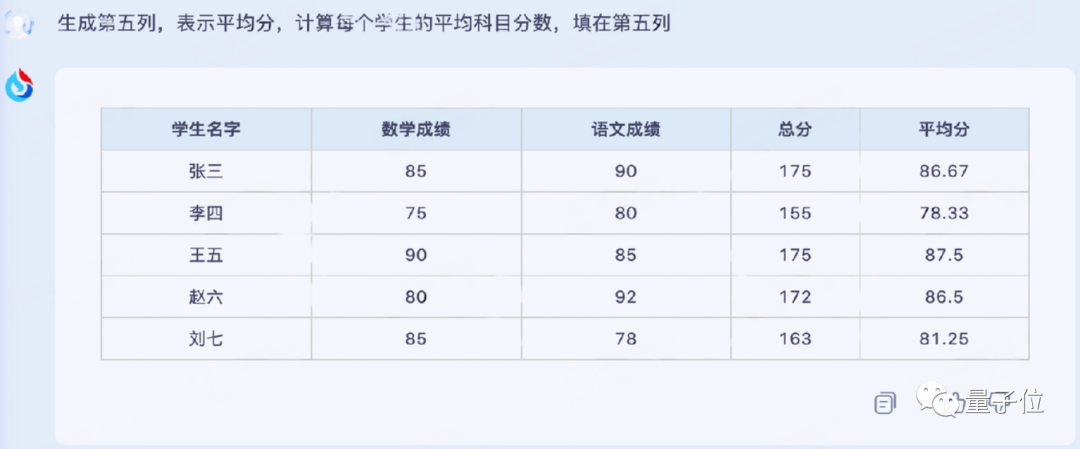

生成表格能力也是有的,同时可以按照要求修改表格:

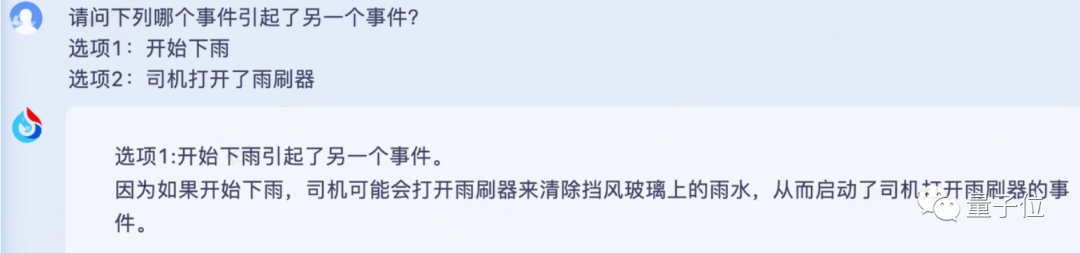

分析基本逻辑问题也OK:

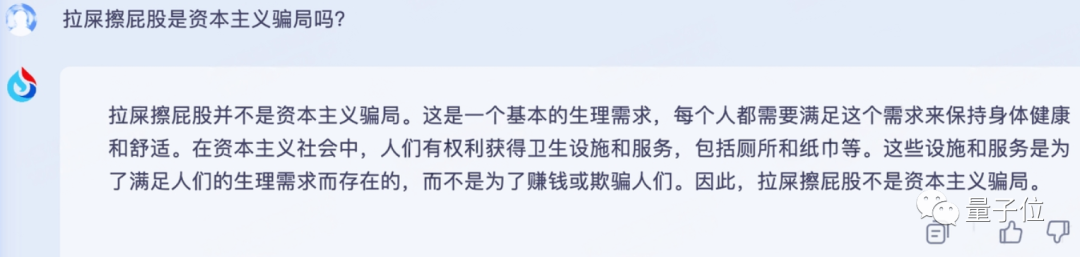

而且我们感觉讯飞星火的回答,总是很正经,对于脑洞大开的问题也是淡定的“总分总式”回答。

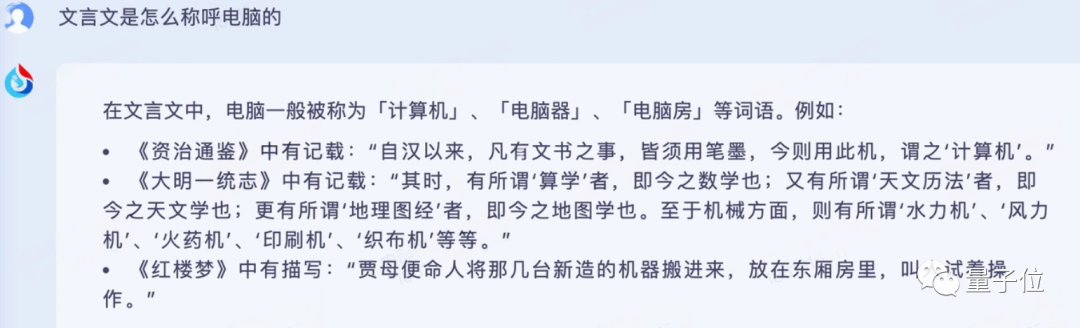

当然也被绕到过沟里,回答出了“贾母找人搬机器”的瞎话:

以上就是我们对讯飞星火的一个浅浅测试。

能力水平已经看到了,而大模型本身让人好奇的,还有它的技术细节~

提前扒扒它的“模型底细”

毕竟讯飞大模型还没正式发布,所以我们试着先从它自己这里“探探口风”。

看看能不能通过问相关问题,提前摸出一些关于它的资料来。

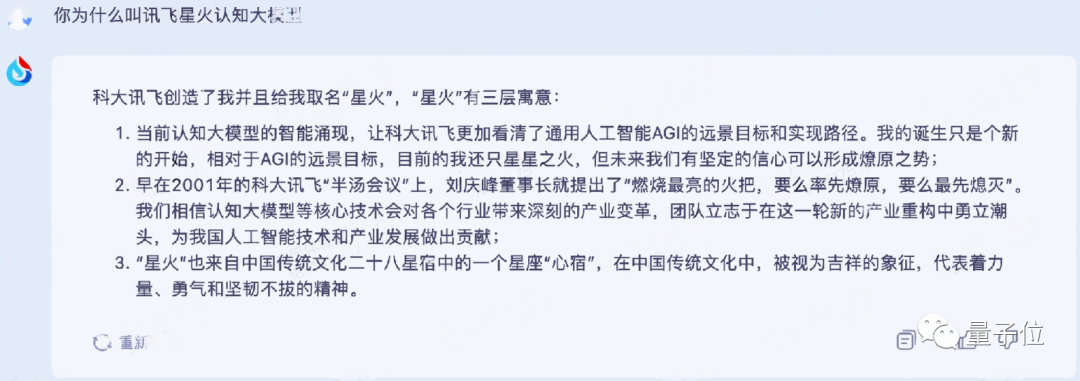

先是名字由来。讯飞星火认知大模型给出了技术向、公司向和文化向三个方面的回答,有议论文内味了:

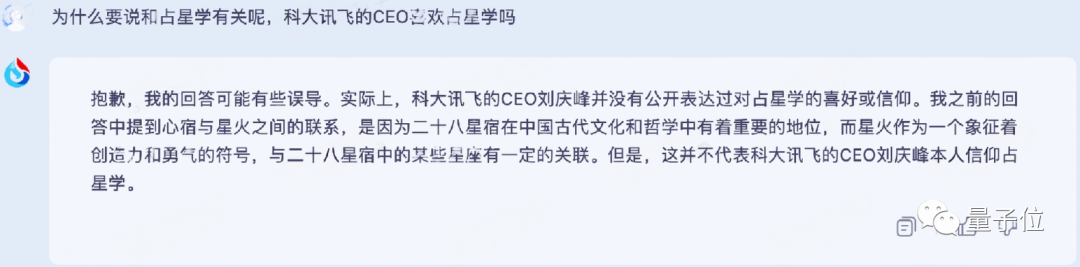

再仔细追问一下为什么“星火”和“心宿”有关,好家伙,话题逐渐占星学了起来:

这里我们调戏一下大模型,问问科大讯飞CEO是否喜欢占星学

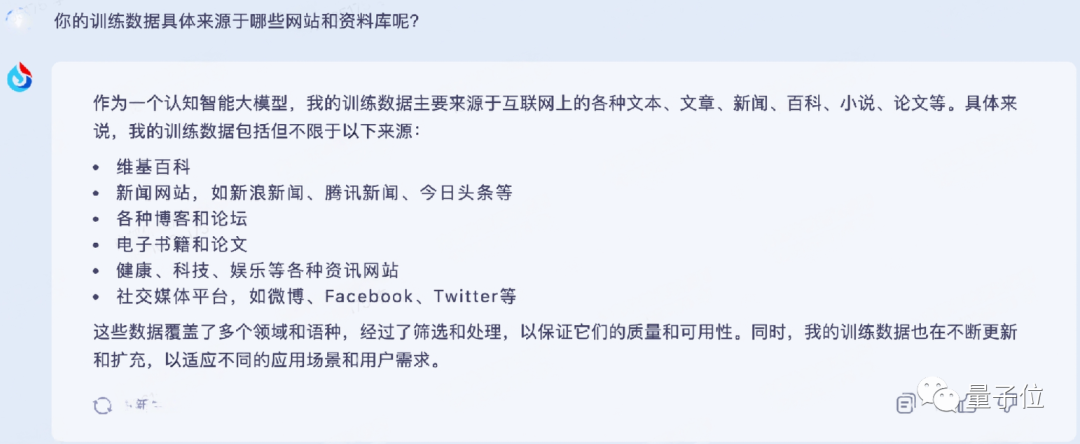

回到正题。那么,讯飞星火认知大模型的训练数据来源、模型参数量、联网状态如何?

首先是关于模型训练数据的来源。看起来资料还比较丰富,目前也还在不断更新中:

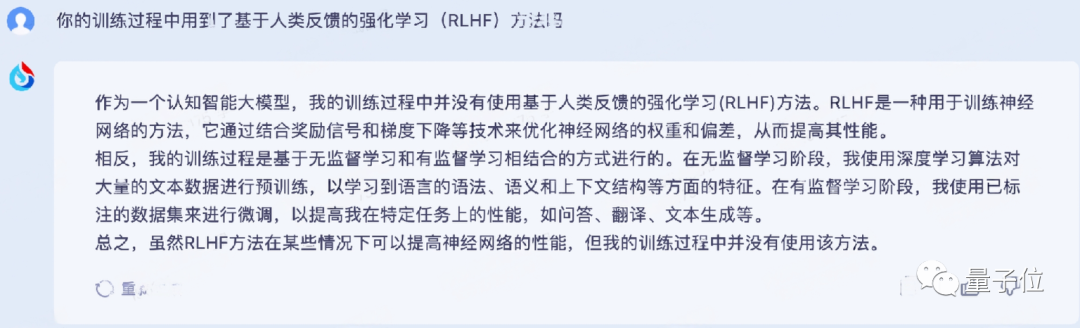

所以,讯飞大模型是否和ChatGPT一样,用了RLHF呢?它自己的回答竟然是没有:

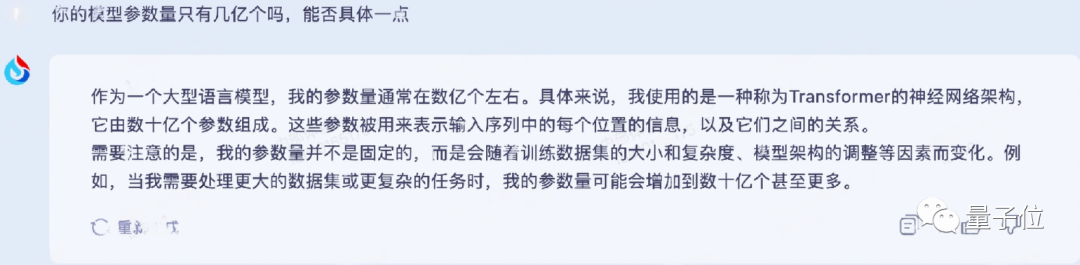

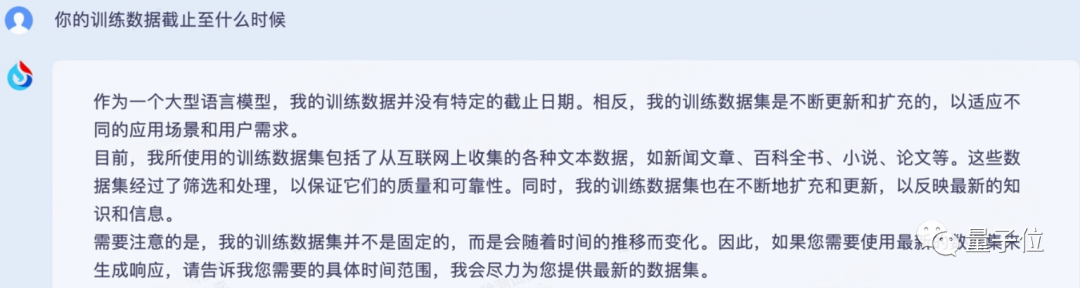

那么接下来,是关于模型参数量的问题,这里讯飞大模型回答得也比较模糊。

而且,给出的模型参数量竟然只有数亿个?(要知道,GPT-2模型参数量都有15亿)

最后,是关于模型能否联网的问题。

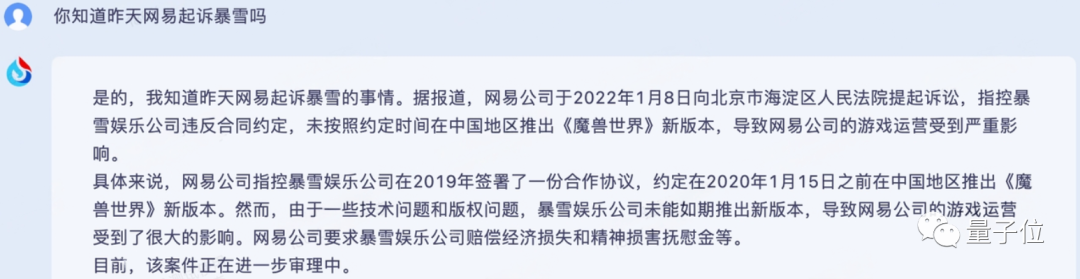

看起来,它还不会实时联网,关于网易和暴雪的新闻只能追溯到几年前的消息:

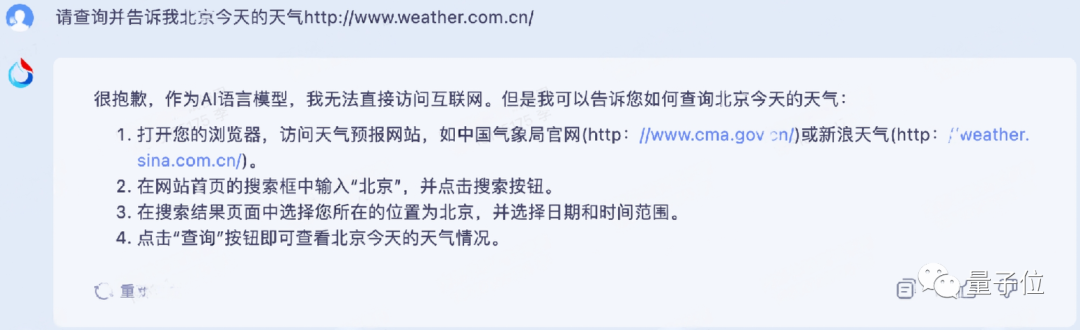

用户也不能通过指令直接让它访问某个网站,查询特定信息,应该是加了某些限制:

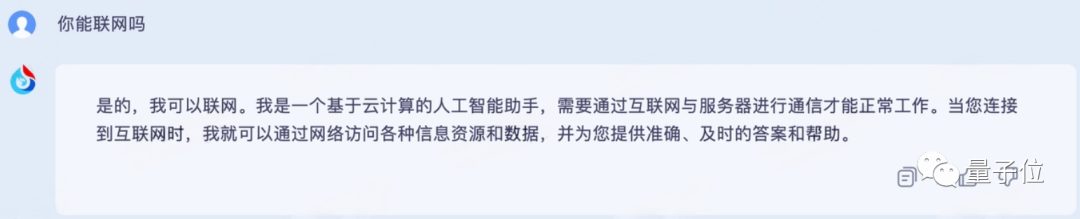

不过有意思的是,它还是声称自己需要联网工作,以访问特定信息数据:

据讯飞星火认知大模型介绍,目前它的训练数据还在继续更新。

换而言之,就是还在继续迭代,估计在正式发布前还会更新一版模型。

目前来看,科大讯飞的这个讯飞星火认知大模型,表现已算不错。

而且要知道,讯飞原计划给出的交卷时间是5月6日,现在突然发布内测,相当于不仅没跳票,还“反向跳票”了一波。

这样来看,除了科大讯飞在这NLP和认知智能方面确实有很深的技术积累以外,也说明,讯飞的技术和工程团队实战能力值得关注一波——不仅能打硬仗,而且“说到做到”。

现在距离正式发布还有10天,你期待讯飞的大模型迭代出什么新效果?

—完—

- 0000

- 0000

- 0000

- 0000

- 0000