AI视频生成框架AnimateDiff 一键从文本到动画

要点:

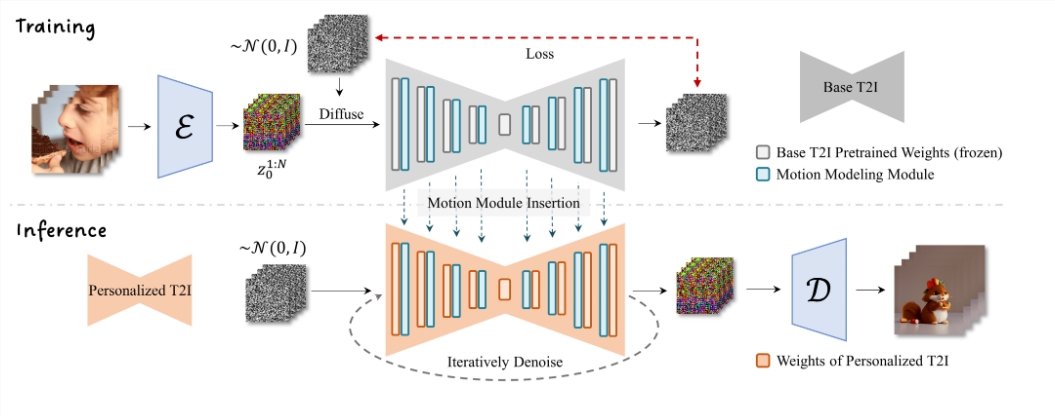

1. AnimateDiff是一个开源框架,可以将定制化文本到图像模型应用于动画生成,保持原有模型的图像质量的基础上生成动画片段,丰富了静态图像的表达能力。

2. 框架在文生图模型中插入动作建模模块,通过训练和参数更新,使模型能够生成个性化的动画图像,而无需对每个模型进行特定优化。

3. AnimateDiff开源项目在GitHub上备受关注,连续数天在Trending Research榜单排名第一,作者还提供了一个简单易用的在线应用,供用户体验模型的能力。

AnimateDiff 是一款强大的工具,它允许您轻松地将文本转化为动画图像,而无需特定的调整。它为用户提供了无限的创意和探索空间,让您可以将文本描述转化为令人惊叹的动画场景。

项目地址:https://github.com/guoyww/animatediff/

核心功能:

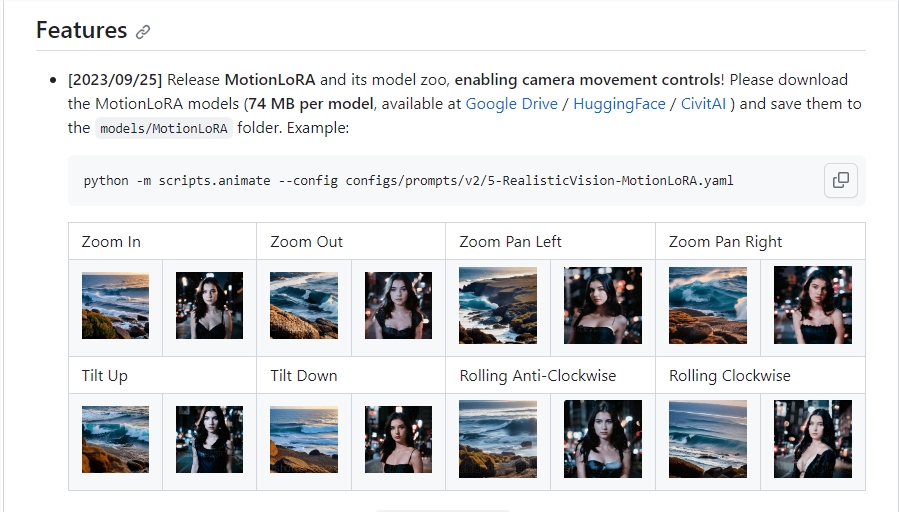

MotionLoRA 模型支持: 最新发布的 MotionLoRA 模型以及其模型库,为您提供了对相机运动的控制能力。您可以轻松地实现缩放、平移、倾斜和旋转等相机动作,从而打造生动的动画场景。

强大的 Motion 模块:这个工具提供了多个 Motion 模块,包括 mm_sd_v14.ckpt、mm_sd_v15.ckpt 和 mm_sd_v15_v2.ckpt,它们支持高分辨率和批处理训练,提供卓越的图像质量。

简便的环境设置:安装和配置 AnimateDiff 非常简单,只需几个命令即可轻松启动。您可以在单个 RTX3090GPU 上进行推理,而且仅需大约12GB的显存。

模型库:AnimateDiff 提供了丰富的模型库,包括 Motion 模块和 MotionLoRA 模块,以及各种可用于不同场景的模型参数。您可以根据自己的需求选择合适的模型进行推理。

Gradio 演示:为了让用户更容易使用 AnimateDiff,该团队还开发了 Gradio 演示。只需运行几个命令,就可以在本地主机上启动演示,通过用户友好的界面进行互动。

- 0001

- 0000

- 0000

- 0000

- 0000